智谱GLM-5 tentokrát open source, v ohrození sú aj pokročilí programátori...

Naozaj, AI v roku 2026 je oveľa šialenejšia ako v roku 2025.

Nedávno som sa, ako človek, ktorý trávi 16 hodín denne v AI, prestal stíhať s tempom evolúcie AI. Mám pocit, že každý deň, keď otvorím oči, sa svet zmenil.

No a včera neskoro v noci spoločnosť Zhipu opäť vytiahla eso z rukáva a priamo open sourcela svoj aktuálne najvýkonnejší vlajkový model: GLM-5.

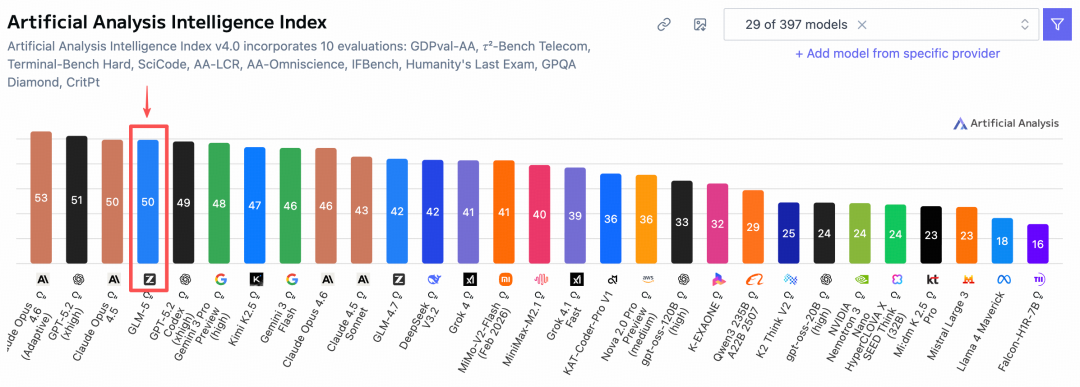

Na globálnom autoritatívnom rebríčku Artificial Analysis sa GLM-5 dostal pred Gemini na štvrté miesto na svete a prvé miesto v open source!

Ako som predpokladal, pamätám si, že keď bola vydaná GLM-4.7, predpovedal som bratom v článku: tipujem, že GLM-4.8 alebo GLM-5 budú vydané pred jarnými slávnosťami, nečakal som, že to príde, haha 😄

A tentokrát číslo verzie konečne nie je ako predtým 4.5, 4.6, 4.7, čo je aktualizácia v štýle zubnej pasty, tentokrát sa dostala priamo na 5.0.

To ukazuje, že nejde o žiadne drobné opravy, ale o veľký skok v základných schopnostiach.

Najprv vám predstavím, čo nové prináša GLM-5:

Jednoducho povedané, predchádzajúce modely sa všeobecne zameriavali na Vibe Coding, čo je takzvaná generácia jednou vetou, aby sa zistilo, kto generuje chladnejšie webové špeciálne efekty, aby sa zistilo, kto dokáže jednou vetou vytvoriť chladnú hru.

Ale GLM-5 s vami tentokrát nesúťaží (konečne!), Zlepšuje schopnosť rozsiahleho modelu od písania kódu po budovanie systémov.

Čo to znamená? Jeho ťažisko už nie je v písaní krásnych front-endových stránok, ale vyvinulo sa na systémového architekta, ktorý dokáže robiť špinavú, ťažkú a dlhodobú prácu.

Dôraz sa kladie na Agentic Engineering, teda na schopnosť inžinierstva inteligentných agentov.

Pozrel som sa na oficiálne údaje, rozsah parametrov sa zvýšil z 355B na 744B (aktivácia 40) a údaje o predtréningu sa zvýšili z 23T na 28,5T.

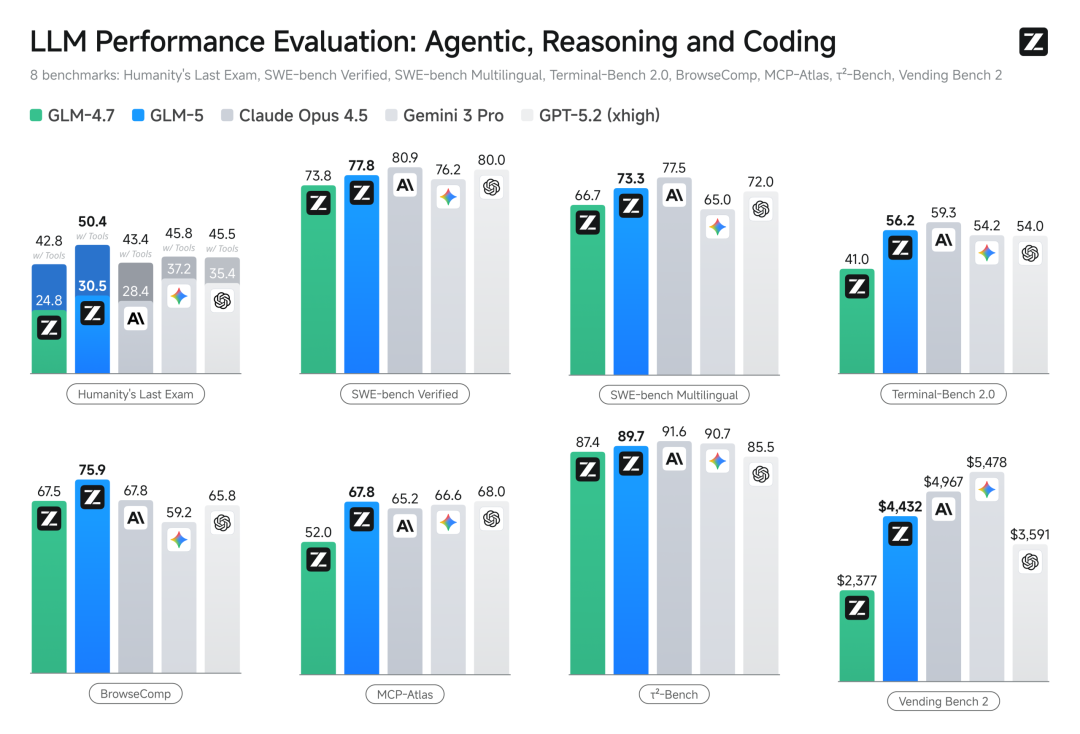

V tomto všeobecne uznávanom benchmarkovom teste programovania SWE-bench-Verified dosiahol skóre 77,8, čím priamo nechal Gemini 3 Pro za sebou, a dá sa povedať, že je porovnateľný s aktuálne uznávaným najvýkonnejším uzavretým modelom Claude Opus 4.5.

Aktuálne je možné ho bezplatne používať na z.ai:

Adresa open source:

GitHub: https://github.com/zai-org/GLM-5

Hugging Face: https://huggingface.co/zai-org/GLM-5

ModelScope: https://modelscope.cn/models/ZhipuAI/GLM-5

V skutočnosti sa pred pár dňami na X zrazu objavil tajomný model s názvom Pony.

V tom čase sa veľa priateľov hádalo, aký druh boha je tento Pony? Názory sa rôznia

V skutočnosti je model s kódovým označením Pony GLM-5, pokiaľ ide o to, prečo sa volá Pony, pravdepodobne preto, že sa blíži rok koňa 🤔.

V tom čase som tiež prvýkrát pripojil Pony z OpenRouter do Claude Code a vyskúšal som ho, úprimne povedané, je naozaj silný (popularita na X je tiež veľmi vysoká).

Vygenerovanie prekladateľskej stanice API trvalo iba 7 minút!

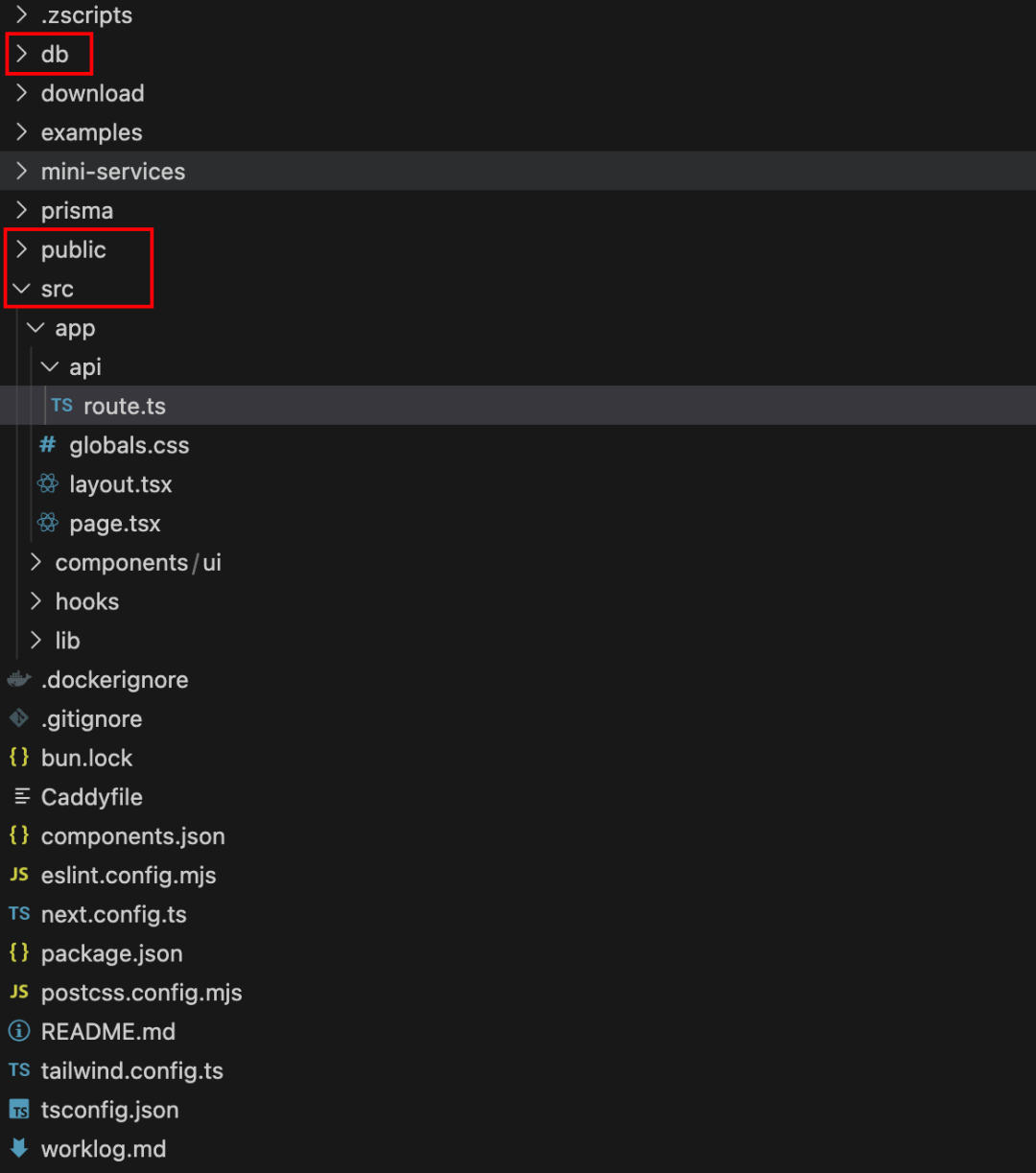

Aj keď ide stále o MVP Demo, funkcie stránky sú už veľmi kompletné a obsahuje back-endovú logiku a databázu, dáta sú dynamické, je malý, ale má všetko.

Po hlbokom zážitku som zistil, že keď GLM-5 vytvára plány, tá chuť je príliš podobná Claude Opus.

Po hlbokom zážitku som zistil, že keď GLM-5 vytvára plány, tá chuť je príliš podobná Claude Opus.

Priatelia, ktorí sú oboznámení s Claude Opus, vedia, že predtým, ako začnete pracovať, ho môžete použiť na vytvorenie veľmi podrobného a logicky prísneho plánu.

GLM-5 má teraz túto schopnosť.

Napríklad, mám vec, ktorú som vždy chcel urobiť, ale bol som príliš lenivý na to, aby som ju začal.

Mám vo svojich rukách hromadu členských účtov Gemini, ChatGPT, Kimi, Zhipu atď.

Pri písaní článkov alebo vyhľadávaní informácií sa často chcem vypočuť názory viacerých AI na niektoré otázky a komplexne ich porovnať.那我就得打开多个浏览器窗口,复制切换不同窗口粘贴发送多次,然后轮流切换窗口查看结果。

虽然也不是多大的事儿,但次数多了真的很烦。

我就在想,能不能做一个浏览器插件,能统一在一个窗口里面,同时向这四个AI的网页端发送同一个问题,然后在插件里面统一收到回复?

但是这玩意儿还挺麻烦的,因为每个AI网站的结构都不一样,还有各种保护机制,需要去分析它们的DOM结构。

于是,我就把这个复杂的任务交给了GLM-5。

开启Claude Code的Plan Mode先让它做个计划

然后它还会跟我互动,询问我的意见:

最终得到的计划非常详细,真的太长了,有633行。。

然后就按照计划开始吭哧吭哧执行了,没想到第一步初始化项目就跑了50多分钟..

在这个过程中,它自动调用了Playwright MCP工具,自己打开浏览器,去访问那几个AI的网站。

它就像一个真的程序员一样,去键检查元素,去分析输入框在哪里,发送按钮的Class是什么,怎么获取返回的文本流...整个过程全自动,我一行代码都没写。

PS:忘记录屏了,因为我同时还在其他窗口跑另一个任务

等待是值得的,我想要的一次提问、全网AI同时回答的插件,就这么热气腾腾地出炉了。

等待是值得的,我想要的一次提问、全网AI同时回答的插件,就这么热气腾腾地出炉了。

这完全就是我需要的东西~

另外,我之前不是做了一个数字人营销视频一键生成平台嘛。

后来为了追求更好的体验,我重构了一下前端,这一重构不要紧,整个项目可以说是乱成了一锅粥:前后端接口对不上,后端的一些老旧逻辑在新前端面前跑不通,Bug非常多,搞起来很麻烦。

这次,我在Claude Code开启plan mode,然后直接把主流程找bug,改bug的任务甩给了GLM-5

先出来一份详细的计划:

确认计划无误后,我就让它吭呲吭呲开始执行了(过程中用到了浏览器mcp来控制)。

它的执行速度并不快。

但并不是模型慢,很多时候,我看那个Token的消耗速度,肉眼可见地一秒钟就窜到上千了。

但是因为任务太复杂,它需要不断地自我反思、调用工具、运行测试。

也有一些时间是消耗在依赖下载,或者命令执行上。

这个修复任务,也整整执行了40多分钟。

可能有的朋友会说,40分钟?我都写完了。

emmm,但这40分钟里,我就开着录屏,刷视频,甚至去遛了狗。

而它是在全神贯注帮我干活,而且是干那种最让人头秃的找Bug和重构的活。

别看它执行得慢,但是最终得到的效果是非常显著的。

我一运行,好家伙,问题基本都搞定了。

请看VCR:

这里面也有一些效果是我后续自己测的时候发现小Bug,然后让它修复并优化的。

但是在修Bug和优化功能这块,我是真的放心交给它。

以前用别的AI改Bug,经常是担心bug越改越多,项目越改越乱,典型的拆了东墙补西墙..

之前为了规避这个问题,得用各种工程化的手段去约束AI。

比如每次修改 强调范围,或者把这些写到规则里面,或者每次只改一个bug,每次改完,还得测一下别的功能...反正很麻烦。

但是用GLM-5修改Bug,体验完全变了。

我从来就是只需要描述现状,把报错日志丢给它,告诉它我期望的效果是什么。

它几乎都能一次修复成功,而且完全不会影响别的功能。

甚至,我在一次对话中,直接把整个流程中发现的四个不同的Bug,一股脑全扔给它,它也能条理清晰的一个个修好。

这种稳健的感觉,真的太舒服了。

我现在可以放心交给GLM-5帮我完成任何复杂的开发任务,基本不会出错。

即便偶尔有问题,大不了在Claude Code里面执行一下回滚命令,倒回去重来就好了。

整个项目用GLM-5优化了一圈之后,所有流程基本都搞定了。Čoskoro plánujem tento projekt sprístupniť ako open source (ešte potrebujem extrahovať rôzne časti API modelu a premeniť ich na konfiguráciu).

„Záver“

Po vyskúšaní GLM-5 je môj najväčší pocit: Domáca AI sa skutočne postavila na nohy.

Pred pár dňami bol vydaný Seedance 2.0 od ByteDance, čo dokazuje, že čínske domáce modely dosiahli v oblasti generovania videa prvotriednu úroveň na svete, priamo prekonávajúc Sora2 a Veo3.1.

A vydanie GLM-5 od spoločnosti Zhipu je odpoveďou, ktorá prekonala očakávania, v ďalšej náročnej oblasti AI Coding.

Predtým sme vždy hovorili, že domáce modely majú medzery v logickom uvažovaní a písaní kódu v porovnaní s GPT, Claude Opus a Gemini.

Ale dnes nám GLM-5 skutočnými výsledkami hovorí: Táto medzera sa zmenšuje.

GLM-5 nie je hračka, ktorú možno použiť len na ukážky, je to produktívny nástroj, ktorý vám skutočne pomôže pracovať, budovať systémy, riešiť dlhé úlohy a zložité problémy.

Najdôležitejšie je, že je open source.

To znamená, že každý vývojár, každá spoločnosť môže mať špičkového architekta AI za nižšie náklady.

A Coding Plan od GLM sa už vypredal, úradníci vydali oznámenie, že urgentne rozširujú kapacitu, a hlavné je, že tentoraz je pripojený klaster s desiatkami tisíc kariet s domácimi čipmi.

Kvôli zvýšeným investíciám do výpočtového výkonu sa však cena mierne zvýšila, našťastie som si predtým zaobstaral balík Max.

Tu je tiež vidieť, že od čipov po modely, od základného výpočtového výkonu po aplikácie vyššej úrovne, budujeme vlastný, prvotriedny technologický zásobník AI.

Rok 2026 je predurčený na to, aby bol rokom explózie aplikácií AI a tiež bláznivejším rokom.

Ak chcete zažiť pocit, že máte špičkového architekta AI, choďte a vyskúšajte GLM-5.Podmienka je, že si musíš uchmatnúť Max balíček, haha.