智谱GLM-5这次开源,让高级程序员也危险了...

真的,2026年的AI比25年疯太多了。

最近我这个一天16个小时泡在AI里面的人,都有点追不上AI进化的速度。感觉每天一睁眼,世界就变了个样。

这不,昨天深夜,智谱又放了个大招,直接开源了他们目前最强的旗舰模型:GLM-5。

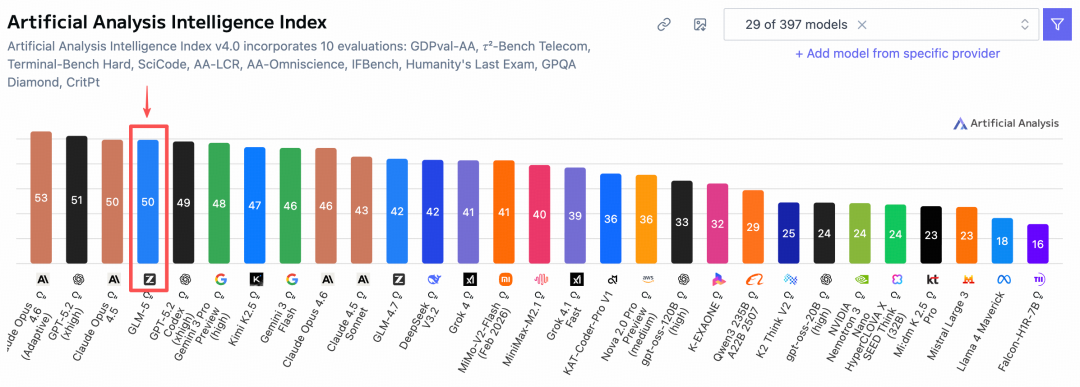

在全球权威的Artificial Analysis榜单里面,GLM-5超越Gemini干到了全球第四、开源第一!

还真是如我所料啊,记得上次GLM-4.7发布的时候,我就在文章里跟兄弟们预测了一波:盲猜GLM-4.8或者GLM-5将在春节前夕发布,没想到真来了,哈哈😄

而且这次的版本号终于不像之前那样4.5、4.6、4.7这样挤牙膏式的更新了,这次直接干到了5.0。

这就说明,不是什么小修小补,是底座能力的大跨越。

先给大家介绍一下,这次GLM-5到底更新了啥:

简单来说,之前的模型,大家普遍都在卷Vibe Coding,就是所谓的一句话生成,看谁生成的网页特效更炫酷,看谁能一句话搓个炫酷的游戏。

但GLM-5这次不跟你卷这个了(终于!),它把大模型的能力从写代码,提升到能构建系统。

什么意思呢?它的重心不再是写漂亮的前端页面,而是进化成了一个能干脏活、累活、做长任务的系统架构师。

强调的是Agentic Engineering,也就是智能体工程能力。

我看了下官方的数据,参数规模从355B干到了744B(激活40),预训练数据从23T提升到了28.5T。

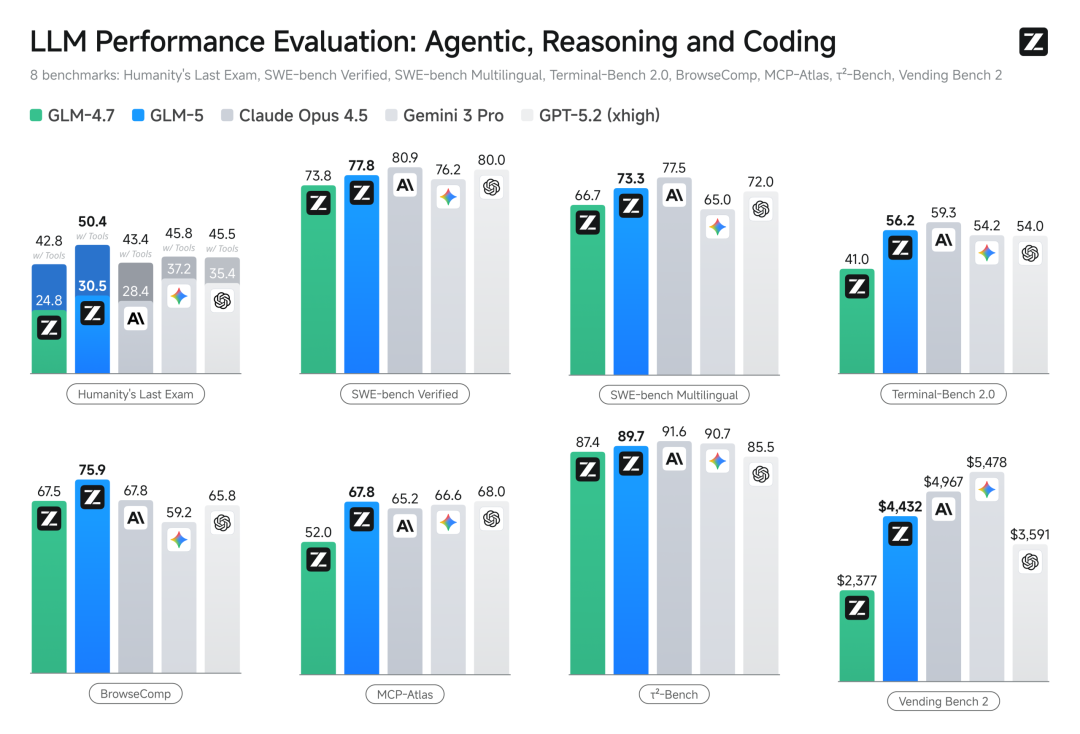

在SWE-bench-Verified这个公认的编程基准测试里,得分77.8,直接把Gemini 3 Pro甩在了身后,和目前公认的最强闭源模型Claude Opus 4.5可以说是不相上下。

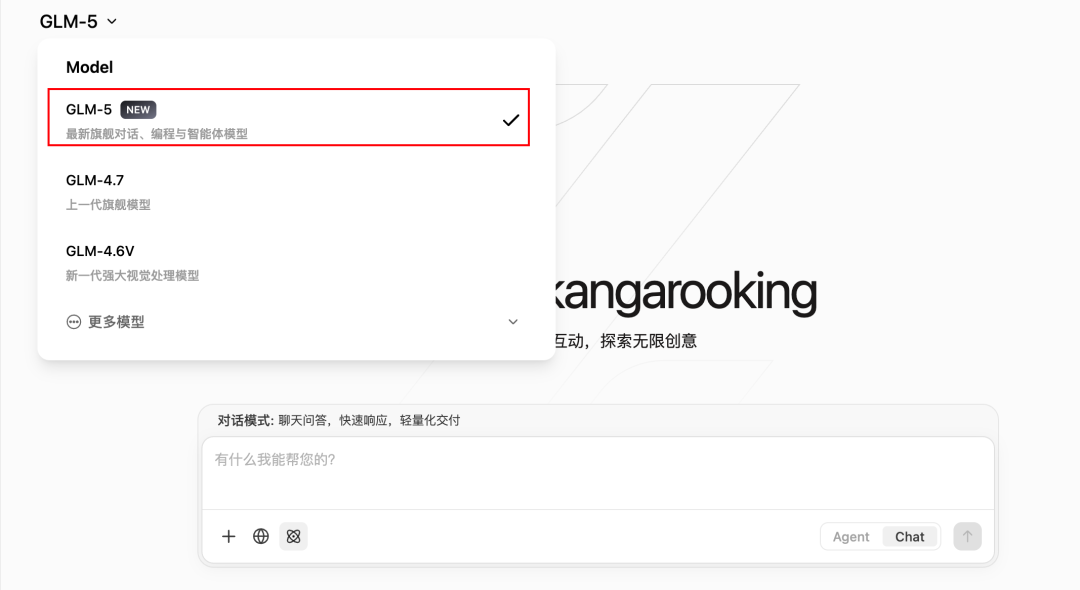

目前在z.ai上面就可以免费使用:

开源地址:

GitHub:https://github.com/zai-org/GLM-5

Hugging Face:https://huggingface.co/zai-org/GLM-5

ModelScope:https://modelscope.cn/models/ZhipuAI/GLM-5

其实在前几天,X上就突然冒出来一个叫Pony的神秘模型。

当时很多朋友都在猜,这个Pony到底是哪路神仙?众说纷纭

其实代号Pony的模型就是GLM-5,至于为什么叫Pony呢,大概是因为马年快到了吧🤔。

我当时也第一时间从OpenRouter把Pony接入到Claude Code里试用了一下,说实话,真滴很强(在X上热度也是非常高)。

只花了7分钟,一次性生成了一个API中转站!

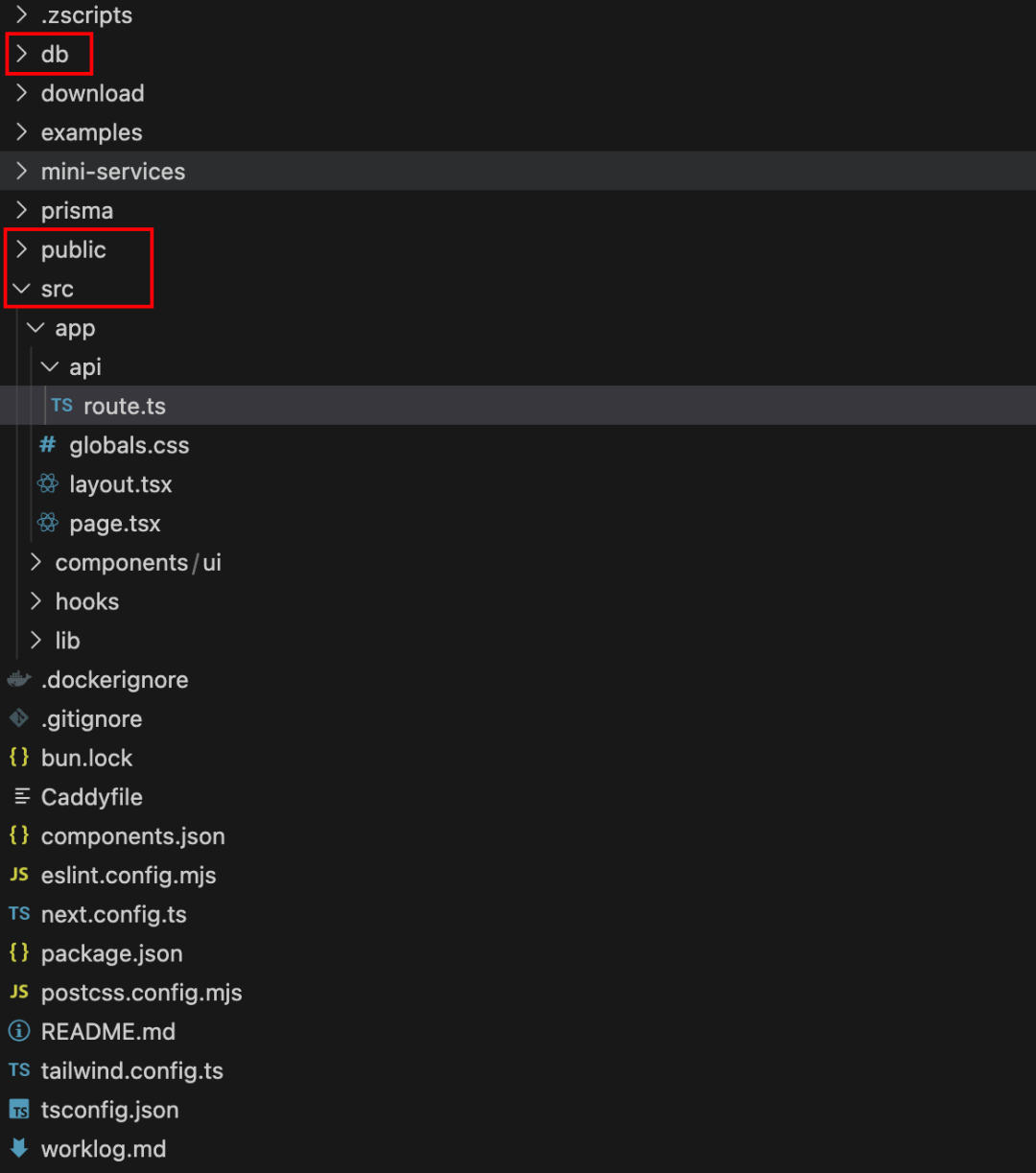

虽然还是MVP Demo,但是页面功能已经很齐全了,而且包含后端逻辑,以及数据库,数据是动态的,麻雀虽小五脏俱全。

在深度体验后,我发现GLM-5在制定计划的时候,那种味道,太像Claude Opus了。

在深度体验后,我发现GLM-5在制定计划的时候,那种味道,太像Claude Opus了。

熟悉Claude Opus的朋友都知道,在干活之前,可以用它会给你列一个非常详细、逻辑严密的计划。

GLM-5现在也有了这个能力。

比如,我有一个一直想做,但是因为懒一直没动手的事儿。

我手头有Gemini、ChatGPT、Kimi、智谱等等一堆会员账号。

平时写文章或者查资料的时候,有些问题我经常会想听听多个AI的意见,综合对比一下。{"title":"","content":"Atëherë do të më duhej të hapja disa dritare shfletuesi, të kopjoja, të ndërroja dritaret e ndryshme, të ngjisja, të dërgoja disa herë, dhe pastaj të ndërroja dritaret me radhë për të parë rezultatet.

Edhe pse nuk është ndonjë gjë e madhe, por kur përsëritet shumë herë, bëhet vërtet e bezdisshme.

Mendova, a mund të bëj një shtojcë shfletuesi që mund të dërgojë të njëjtën pyetje në faqet e internetit të këtyre katër AI-ve në të njëjtën kohë, brenda një dritareje, dhe pastaj të marr përgjigjet në mënyrë të unifikuar brenda shtojcës?

Por kjo gjë është goxha e vështirë, sepse struktura e çdo faqeje interneti të AI-ve është e ndryshme, dhe ka mekanizma të ndryshëm mbrojtjeje, që kërkojnë analizimin e strukturës së tyre DOM.

Kështu, unë ia dhashë këtë detyrë komplekse GLM-5.

Hapni Plan Mode të Claude Code për ta lënë të bëjë një plan fillimisht

Pastaj ai do të ndërveprojë me mua, duke kërkuar mendimin tim:

Plani përfundimtar i marrë është shumë i detajuar, vërtet shumë i gjatë, ka 633 rreshta..

Pastaj filloi të ekzekutohej sipas planit, por hapi i parë i inicializimit të projektit zgjati më shumë se 50 minuta..

Gjatë këtij procesi, ai thirri automatikisht mjetin Playwright MCP, hapi vetë shfletuesin dhe vizitoi faqet e internetit të atyre AI-ve.

Ai është si një programues i vërtetë, duke kontrolluar elementet, duke analizuar se ku është kutia e hyrjes, cili është Class i butonit të dërgimit, si të marrë rrjedhën e tekstit të kthyer... i gjithë procesi është automatik, unë nuk kam shkruar asnjë rresht kodi.

PS: Harrova të regjistroj ekranin, sepse në të njëjtën kohë po ekzekutoja një detyrë tjetër në një dritare tjetër

Pritja ia vlejti, shtojca që doja, një pyetje dhe përgjigje nga të gjitha AI-të në të njëjtën kohë, doli e sapo dalë nga furra.

Pritja ia vlejti, shtojca që doja, një pyetje dhe përgjigje nga të gjitha AI-të në të njëjtën kohë, doli e sapo dalë nga furra.

Kjo është pikërisht ajo që më duhej~

Përveç kësaj, unë nuk kisha bërë një platformë për gjenerimin e videove të marketingut me avatarë dixhitalë me një klikim?

Më vonë, për të ndjekur një përvojë më të mirë, e ristrukturova front-end-in, dhe kjo ristrukturim e bëri të gjithë projektin një rrëmujë: ndërfaqet front-end dhe back-end nuk përputheshin, disa logjika të vjetra të back-end nuk funksiononin me front-end-in e ri, kishte shumë defekte, dhe ishte shumë e vështirë për t'u rregulluar.

Këtë herë, në Claude Code hapa plan mode, dhe pastaj ia dhashë detyrën e gjetjes dhe rregullimit të defekteve në procesin kryesor GLM-5

Fillimisht doli një plan i detajuar:

Pasi konfirmova që plani ishte i saktë, e lashë të fillonte të ekzekutohej (gjatë procesit u përdor browser mcp për të kontrolluar).

Shpejtësia e ekzekutimit të tij nuk është e shpejtë.

Por nuk është se modeli është i ngadaltë, shpeshherë, shoh shpejtësinë e konsumimit të Token-ave, që rritet me sy të lirë në mijëra në sekondë.

Por për shkak se detyra është shumë komplekse, ai duhet të reflektojë vazhdimisht mbi veten, të thërrasë mjete, të ekzekutojë teste.

Disa kohë harxhohet edhe në shkarkimin e varësive ose në ekzekutimin e komandave.

Edhe kjo detyrë e riparimit zgjati plot 40 minuta.

Disa miq mund të thonë, 40 minuta? Unë do ta kisha shkruar tashmë.

Emm, por në këto 40 minuta, unë po shikoja regjistrimin e ekranit, po shikoja video, madje dola edhe për të shëtitur qenin.

Dhe ai po punonte me gjithë mendjen për të më ndihmuar, dhe po bënte atë lloj pune që të çmend më shumë, gjetjen e defekteve dhe ristrukturimin.

Mos mendoni se ekzekutohet ngadalë, por efekti përfundimtar është shumë i dukshëm.

Kur e ekzekutova, o burrë, problemet ishin kryesisht të zgjidhura.

Ju lutem shikoni VCR:

Këtu ka edhe disa efekte që i zbulova më vonë kur po testoja vetë defekte të vogla, dhe e lashë ta riparonte dhe optimizonte.

Por në riparimin e defekteve dhe optimizimin e funksioneve, unë vërtet kam besim tek ai.

Më parë, kur përdorja AI të tjera për të rregulluar defekte, shpesh shqetësohesha se defektet do të shtoheshin gjithnjë e më shumë, dhe projekti do të bëhej gjithnjë e më i çrregullt, tipike "hiq murin lindor për të mbushur murin perëndimor"..

Më parë, për të shmangur këtë problem, duhej të përdorja mjete të ndryshme inxhinierike për të kufizuar AI.

Për shembull, sa herë që modifikoja, theksoja fushën, ose i shkruaja ato në rregulla, ose modifikoja vetëm një defekt sa herë, dhe sa herë që mbaroja së modifikuari, duhej të testoja funksione të tjera... gjithsesi, ishte shumë e vështirë.

Por përdorimi i GLM-5 për të modifikuar defekte, përvoja ndryshoi plotësisht.

Unë kurrë nuk kam pasur nevojë të përshkruaj gjendjen aktuale, t'i hedh atij regjistrat e gabimeve, dhe t'i them se cili është efekti që pres.

Ai pothuajse gjithmonë mund të riparojë me sukses një herë, dhe nuk do të ndikojë fare në funksione të tjera.

Madje, në një bisedë, unë i hodha të gjitha katër defektet e ndryshme që gjeta në të gjithë procesin, dhe ai mund t'i rregullonte një nga një në mënyrë të qartë.

Kjo ndjenjë e qëndrueshme është vërtet shumë e rehatshme.

Tani mund t'ia besoj me besim GLM-5 për të më ndihmuar të përfundoj çdo detyrë komplekse zhvillimi, dhe në thelb nuk do të bëj gabime.

Edhe nëse ka ndonjë problem herë pas here, thjesht ekzekutoni një komandë rollback në Claude Code, dhe kthehuni prapa për të filluar nga e para.

Pasi i gjithë projekti u optimizua nga GLM-5, të gjitha proceset ishin në thelb të zgjidhura."Unë gjithashtu planifikoj ta bëj këtë projekt me burim të hapur shumë shpejt (duhet të nxjerr API-t e ndryshme të modelit dhe t'i kthej në konfigurime).

"Përfundimtare"

Pasi e provova GLM-5, ndjesia ime më e madhe është: AI kineze është ngritur vërtet.

Para disa ditësh, u lëshua Seedance 2.0 i ByteDance, duke vërtetuar se modelet kineze vendase kanë arritur nivelin e parë botëror në fushën e gjenerimit të videove, duke tejkaluar drejtpërdrejt Sora2 dhe Veo3.1.

Dhe këtë herë, lëshimi i Zhihu GLM-5 ka dhënë një përgjigje që tejkalon pritshmëritë në një pistë tjetër të vështirë, AI Coding.

Ne thoshim gjithmonë se modelet vendase kishin ende një hendek me GPT, Claude Opus dhe Gemini në arsyetimin logjik dhe shkrimin e kodit.

Por sot, GLM-5 na tregon me performancë konkrete: ky hendek po ngushtohet.

GLM-5 nuk është një lodër që mund të përdoret vetëm për Demo, është një mjet produktiv që mund t'ju ndihmojë vërtet të punoni, të ndërtoni sisteme, të zgjidhni detyra të gjata dhe probleme komplekse.

Më e rëndësishmja, është me burim të hapur.

Kjo do të thotë që çdo zhvillues, çdo ndërmarrje, mund të ketë një arkitekt AI të nivelit të lartë me një kosto më të ulët.

Dhe aktualisht, Plani i Kodimit GLM është shitur si i çmendur. Zyrtarët kanë lëshuar një njoftim duke thënë se po zgjerohen me urgjencë dhe pika kryesore është se këtë herë po hyjnë në një grup prej dhjetëra mijëra kartash të çipave vendas.

Megjithatë, për shkak të investimit të shtuar në fuqinë llogaritëse, çmimi është rritur pak, por fatmirësisht mora paketën Max më parë.

Këtu mund të shihet gjithashtu se nga çipat te modelet, nga fuqia llogaritëse themelore te aplikacionet e nivelit të lartë, ne po ndërtojmë një grup teknologjik AI të nivelit të lartë që është plotësisht i yni.

2026 është i destinuar të jetë një vit shpërthimi për aplikacionet AI dhe gjithashtu një vit më i çmendur.

Nëse dëshironi gjithashtu të përjetoni ndjenjën e të pasurit një arkitekt AI të nivelit të lartë, shkoni dhe provoni GLM-5 sa më shpejt të jetë e mundur.Parakusht është të kapni paketën Max, haha.