Delikado na Rin ang mga Senior Programmer sa Pag-open Source ng GLM-5 ng Zhipu...

Totoo, mas baliw ang AI sa 2026 kaysa sa 25.

Nitong mga nakaraang araw, ako na halos 16 na oras sa isang araw nakababad sa AI, medyo nahihirapan na akong sumabay sa bilis ng ebolusyon ng AI. Parang sa bawat paggising ko, nag-iba na ang mundo.

Ayun nga, kagabi, nagpakawala na naman ng malaking sorpresa ang Zhipu, direktang nag-open source ng kanilang kasalukuyang pinakamalakas na flagship model: GLM-5.

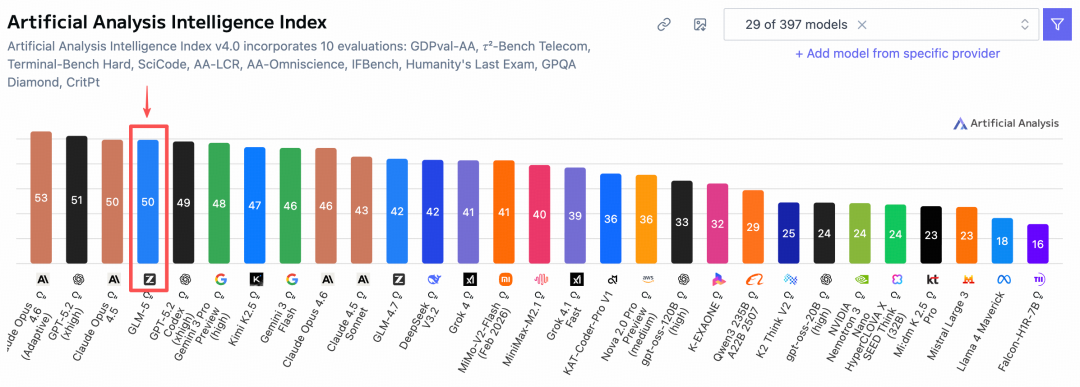

Sa pandaigdigang awtoridad na Artificial Analysis listahan, nalampasan ng GLM-5 ang Gemini at umakyat sa ika-apat sa buong mundo, at ika-una sa open source!

Talagang tama ang hinala ko, naalala ko noong inilabas ang GLM-4.7, nagbigay na ako ng hula sa mga kapatid sa artikulo: hula ko ilalabas ang GLM-4.8 o GLM-5 bago ang Spring Festival, hindi ko akalain na mangyayari nga, haha 😄

At sa pagkakataong ito, hindi na parang dati na 4.5, 4.6, 4.7 na parang pinipiga lang ang toothpaste, direkta na itong umabot sa 5.0.

Ibig sabihin, hindi ito basta maliit na pagbabago, kundi malaking pagtalon sa kakayahan ng base.

Ipakilala ko muna sa inyo, kung ano ba talaga ang mga update sa GLM-5:

Sa madaling salita, sa mga nakaraang modelo, karaniwang nagpapagalingan ang lahat sa Vibe Coding, yung tinatawag na isang pangungusap na pagbuo, kung sino ang makakagawa ng mas magandang web effect, kung sino ang makakagawa ng isang cool na laro sa isang pangungusap.

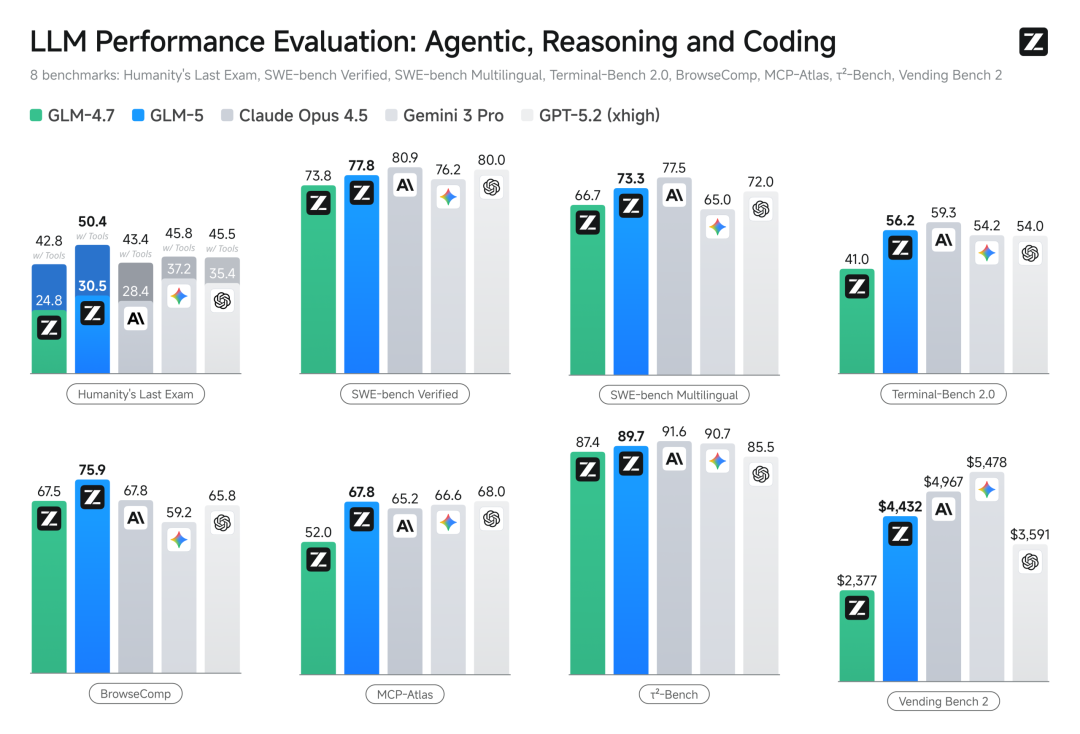

Pero sa pagkakataong ito, hindi na makikipagkumpitensya ang GLM-5 sa inyo dito (sa wakas!), itinaas nito ang kakayahan ng malaking modelo mula sa pagsusulat ng code, hanggang sa kakayahang bumuo ng sistema.

Anong ibig sabihin nito? Ang pokus nito ay hindi na sa pagsusulat ng magagandang front-end na pahina, kundi nag-evolve na ito sa isang arkitekto ng sistema na kayang gumawa ng marurumi at mabibigat na trabaho, at gumawa ng mahabang gawain.

Binibigyang-diin ang Agentic Engineering, ibig sabihin, ang kakayahan sa intelligent body engineering.

Tiningnan ko ang opisyal na datos, ang laki ng parameter ay tumaas mula 355B hanggang 744B (activation 40), ang data ng pre-training ay tumaas mula 23T hanggang 28.5T.

Sa SWE-bench-Verified na kinikilalang benchmark ng programming, nakakuha ito ng 77.8 puntos, direktang iniwan ang Gemini 3 Pro, at masasabing halos kapantay na nito ang kasalukuyang kinikilalang pinakamalakas na closed-source na modelo na Claude Opus 4.5.

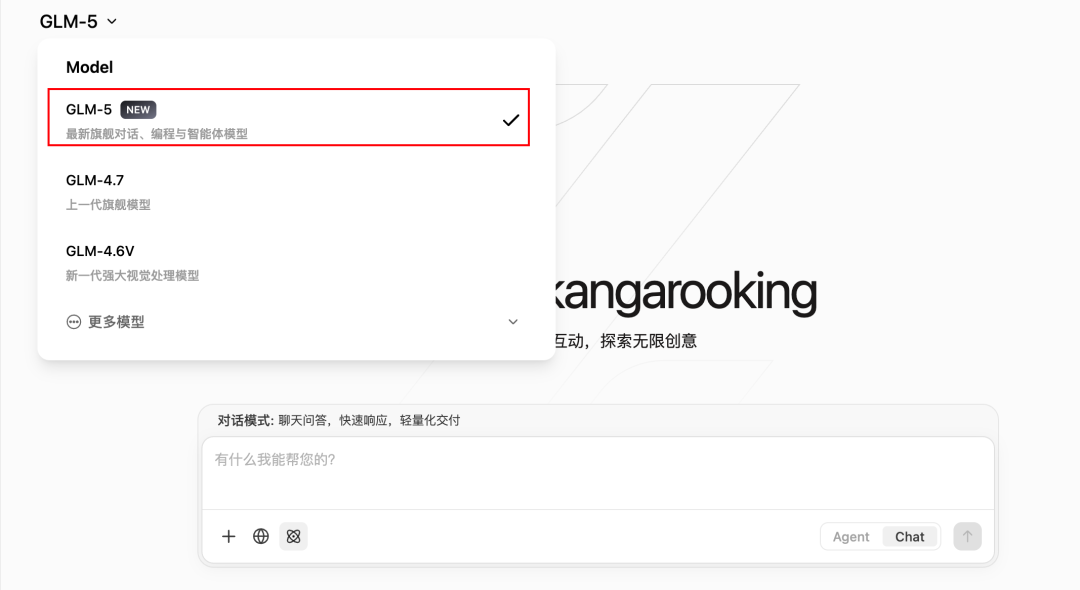

Sa kasalukuyan, maaari itong gamitin nang libre sa z.ai:

Open source address:

GitHub:https://github.com/zai-org/GLM-5

Hugging Face:https://huggingface.co/zai-org/GLM-5

ModelScope:https://modelscope.cn/models/ZhipuAI/GLM-5

Sa katunayan, nitong mga nakaraang araw, biglang lumitaw sa X ang isang misteryosong modelo na tinatawag na Pony.

Noong panahong iyon, maraming kaibigan ang nagtatanong, sino kaya itong Pony na ito? Maraming haka-haka.

Sa katunayan, ang modelong may code name na Pony ay ang GLM-5, kung bakit tinawag na Pony, marahil dahil malapit na ang Year of the Horse 🤔.

Sinubukan ko rin agad na ikonekta ang Pony mula sa OpenRouter sa Claude Code, sa totoo lang, napakalakas nito (napakataas din ng kasikatan nito sa X).

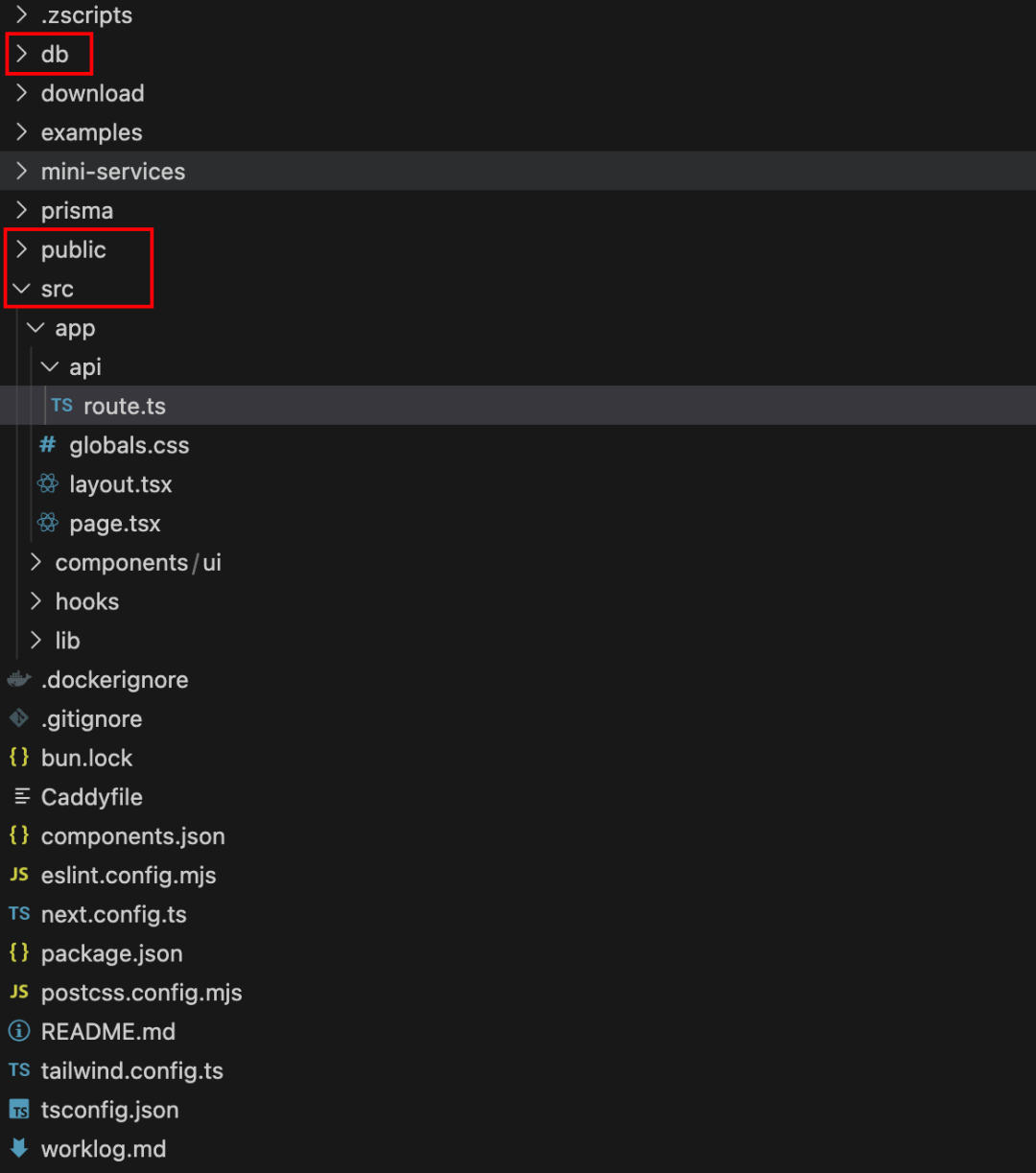

Sa loob lamang ng 7 minuto, nakabuo ito ng API transit station nang sabay-sabay!

Bagama't MVP Demo pa rin ito, kumpleto na ang mga function ng pahina, at kasama rin ang backend logic, at database, ang data ay dynamic, maliit man ngunit kumpleto.

Pagkatapos ng malalim na karanasan, natuklasan ko na kapag gumagawa ng plano ang GLM-5, ang lasa nito ay parang Claude Opus.

Pagkatapos ng malalim na karanasan, natuklasan ko na kapag gumagawa ng plano ang GLM-5, ang lasa nito ay parang Claude Opus.

Alam ng mga pamilyar sa Claude Opus na bago gumawa ng trabaho, maaari itong magbigay sa iyo ng isang napakadetalyado at lohikal na plano.

Mayroon na ring kakayahan ang GLM-5 ngayon.

Halimbawa, mayroon akong isang bagay na matagal ko nang gustong gawin, ngunit dahil sa katamaran ay hindi ko pa rin ginagawa.

Mayroon akong isang grupo ng mga membership account tulad ng Gemini, ChatGPT, Kimi, Zhipu, atbp.

Kapag nagsusulat ako ng mga artikulo o naghahanap ng impormasyon, madalas kong gustong marinig ang mga opinyon ng maraming AI sa ilang mga tanong, at pagkumparahin ang mga ito.Kung gayon, kailangan kong magbukas ng maraming window ng browser, kopyahin at ilipat ang iba't ibang window para i-paste at ipadala nang maraming beses, at pagkatapos ay isa-isang ilipat ang mga window upang tingnan ang mga resulta.

Bagama't hindi naman ito malaking bagay, nakakainis talaga kapag madalas.

Naisip ko, maaari bang gumawa ng isang browser plugin na maaaring sabay-sabay na magpadala ng parehong tanong sa mga web page ng apat na AI sa isang window, at pagkatapos ay tumanggap ng mga sagot nang sabay-sabay sa plugin?

Ngunit ang bagay na ito ay medyo nakakagulo, dahil ang istraktura ng bawat AI website ay iba, at mayroon ding iba't ibang mga mekanismo ng proteksyon, na nangangailangan ng pagsusuri sa kanilang istraktura ng DOM.

Kaya, ipinasa ko ang kumplikadong gawaing ito sa GLM-5.

Simulan ang Claude Code's Plan Mode upang gumawa muna ito ng plano

Pagkatapos ay makikipag-ugnayan din ito sa akin at hihingi ng aking opinyon:

Ang huling plano ay napakadetalyado, napakahaba talaga, may 633 linya..

Pagkatapos ay nagsimula itong magtrabaho ayon sa plano, hindi ko inaasahan na ang unang hakbang ng pag-initialize ng proyekto ay tumagal ng higit sa 50 minuto..

Sa prosesong ito, awtomatiko nitong tinawag ang Playwright MCP tool, binuksan ang browser mismo, at binisita ang mga website ng ilang AI.

Ito ay parang isang tunay na programmer, sinusuri ang mga elemento, sinusuri kung nasaan ang input box, kung ano ang Class ng send button, kung paano makuha ang return text stream... Ang buong proseso ay awtomatiko, hindi ako sumulat ng isang linya ng code.

PS: Nakalimutan kong mag-record ng screen, dahil sabay-sabay din akong nagpapatakbo ng isa pang gawain sa ibang window

Sulit ang paghihintay, ang plugin na gusto ko na sabay-sabay na nagtatanong at sumasagot ang lahat ng AI sa buong network ay mainit na lumabas.

Sulit ang paghihintay, ang plugin na gusto ko na sabay-sabay na nagtatanong at sumasagot ang lahat ng AI sa buong network ay mainit na lumabas.

Ito talaga ang kailangan ko~

Bukod pa rito, hindi ba gumawa ako dati ng isang digital human marketing video one-click generation platform?

Sa kalaunan, upang ituloy ang isang mas mahusay na karanasan, muling itinayo ko ang frontend. Ang muling pagtatayo na ito ay hindi mahalaga, ang buong proyekto ay masasabing isang gulo: ang mga interface ng frontend at backend ay hindi tumutugma, ang ilang lumang lohika ng backend ay hindi maaaring tumakbo sa harap ng bagong frontend, maraming mga Bug, at napakahirap gawin.

Sa pagkakataong ito, binuksan ko ang plan mode sa Claude Code, at pagkatapos ay direktang ipinasa ang pangunahing proseso ng paghahanap ng bug at pag-aayos ng bug sa GLM-5

Unang lumabas ang isang detalyadong plano:

Pagkatapos kumpirmahin na tama ang plano, hinayaan ko itong magsimulang magtrabaho (ginamit ang browser mcp upang kontrolin sa proseso).

Ang bilis ng pagpapatupad nito ay hindi mabilis.

Ngunit hindi ito dahil sa mabagal ang modelo. Sa maraming pagkakataon, nakita ko na ang bilis ng pagkonsumo ng Token ay tumaas sa libu-libo sa isang segundo.

Ngunit dahil masyadong kumplikado ang gawain, kailangan nitong patuloy na magmuni-muni, tumawag ng mga tool, at magpatakbo ng mga pagsubok.

Mayroon ding ilang oras na ginugol sa pag-download ng mga dependency o pagpapatupad ng mga command.

Ang gawaing pag-aayos na ito ay tumagal din ng higit sa 40 minuto.

Maaaring sabihin ng ilang kaibigan, 40 minuto? Tapos ko na sana ang pagsulat.

Emm, ngunit sa 40 minutong ito, binuksan ko ang pag-record ng screen, nanood ng mga video, at naglakad pa nga ng aso.

At ito ay nakatuon sa pagtulong sa akin sa trabaho, at ito ay gumagawa ng uri ng trabaho na pinakanakakagulo sa paghahanap ng mga Bug at muling pagtatayo.

Huwag isipin na ito ay mabagal sa pagpapatupad, ngunit ang panghuling epekto ay napakahalaga.

Sa sandaling patakbuhin ko ito, wow, halos lahat ng mga problema ay nalutas.

Panoorin ang VCR:

Mayroon ding ilang mga epekto dito na natuklasan ko nang subukan ko ito sa ibang pagkakataon at hinayaan ko itong ayusin at i-optimize.

Ngunit sa pag-aayos ng mga Bug at pag-optimize ng mga function, talagang kampante ako na ipaubaya ito dito.

Dati, kapag gumagamit ng ibang AI upang ayusin ang mga Bug, madalas akong nag-aalala na ang mga bug ay magiging mas maraming bug, at ang proyekto ay magiging mas magulo, na tipikal na pagtatakip ng isang butas sa pamamagitan ng pagbubukas ng isa pa..

Dati, upang maiwasan ang problemang ito, kailangan kong gumamit ng iba't ibang mga paraan ng engineering upang paghigpitan ang AI.

Mahalaga, halimbawa, na bigyang-diin ang saklaw sa bawat pagbabago, o isulat ang mga ito sa mga panuntunan, o baguhin lamang ang isang bug sa bawat pagkakataon, at subukan ang iba pang mga function pagkatapos ng bawat pagbabago... Anyway, napakahirap.

Ngunit ang paggamit ng GLM-5 upang ayusin ang mga Bug ay ganap na nagbago ang karanasan.

Kailangan ko lamang ilarawan ang kasalukuyang sitwasyon, ibigay dito ang mga error log, at sabihin dito kung ano ang inaasahan kong epekto.

Halos palagi itong nagtatagumpay sa pag-aayos nito nang isang beses, at hindi nito ganap na maaapektuhan ang iba pang mga function.

Kahit na, sa isang pag-uusap, direktang ibinigay ko dito ang lahat ng apat na magkakaibang Bug na natuklasan sa buong proseso, at maaari rin nitong ayusin ang mga ito nang isa-isa sa isang malinaw na paraan.

Ang ganitong uri ng matatag na pakiramdam ay talagang napakaginhawa.

Ngayon ay maaari kong kampante na ipaubaya sa GLM-5 na kumpletuhin ang anumang kumplikadong gawain sa pag-develop para sa akin, at karaniwang hindi ito nagkakamali.

Kahit na may mga problema paminsan-minsan, maaari ko lamang isagawa ang command ng rollback sa Claude Code at bumalik upang gawin itong muli.

Pagkatapos na ma-optimize ang buong proyekto gamit ang GLM-5, karaniwang nalutas na ang lahat ng proseso.Plano ko rin na i-open source ang proyektong ito sa lalong madaling panahon (kailangan ko pang ihiwalay ang iba't ibang modelo ng API at gawing configuration).

«Huling»

Pagkatapos kong maranasan ang GLM-5, ang pinakamalaking pakiramdam ko ay: Ang AI ng Tsina ay talagang nakatayo na.

Noong nakaraang dalawang araw, inilabas ang Seedance 2.0 ng ByteDance, na nagpapatunay na ang mga domestic na modelo ng Tsina ay umabot na sa unang antas ng mundo sa larangan ng pagbuo ng video, na direktang nalampasan ang Sora2 at Veo3.1.

At ang paglabas ng Zhipu GLM-5 sa pagkakataong ito ay nagbigay ng hindi inaasahang sagot sa isa pang hard-core na track, ang AI Coding.

Dati nating sinasabi na ang mga domestic na modelo ay may puwang pa rin sa GPT, Claude Opus, at Gemini sa lohikal na pangangatwiran at pagsusulat ng code.

Ngunit ngayon, sinasabi sa atin ng GLM-5 na may tunay na pagganap: ang puwang na ito ay tinutugunan.

Ang GLM-5 ay hindi rin isang laruan na magagamit lamang para sa mga Demo, ito ay isang tool sa pagiging produktibo na talagang makakatulong sa iyo na gumana, bumuo ng mga system, malutas ang mga mahahabang gawain, at mga kumplikadong problema.

Ang pinakamahalaga, ito ay open source.

ang ibig sabihin nito, ang bawat developer, bawat kumpanya, ay maaaring magkaroon ng isang nangungunang arkitekto ng AI sa mas mababang halaga.

At sa kasalukuyan, ang Coding Plan ng GLM ay nabenta na, at naglabas ang opisyal ng anunsyo na sila ay nagpapalawak ng kapasidad nang madalian, at ang pokus ay, ang pagkakataong ito ay konektado sa libu-libong card cluster ng mga domestic chip.

Gayunpaman, dahil sa pagtaas ng pamumuhunan sa computing power, tumaas ang presyo, mabuti na lang at nakuha ko ang Max package dati.

Dito rin natin makikita na mula sa mga chip hanggang sa mga modelo, mula sa pinagbabatayan na computing power hanggang sa mga upper-level na application, bumubuo tayo ng isang ganap na sariling, nangungunang stack ng teknolohiya ng AI.

Ang 2026 ay nakatakdang maging isang taon ng pagsabog ng mga application ng AI, at isa ring mas nakakabaliw na taon.

Kung gusto mo ring maranasan ang pakiramdam ng pagkakaroon ng isang nangungunang arkitekto ng AI, subukan ang GLM-5 sa lalong madaling panahon.Basta't makakuha ka ng Max package, haha.