智谱GLM-5这次开源,让高级程序员也危险了...

真的,2026年的AI比25年疯太多了。

最近我这个一天16个小时泡在AI里面的人,都有点追不上AI进化的速度。感觉每天一睁眼,世界就变了个样。

这不,昨天深夜,智谱又放了个大招,直接开源了他们目前最强的旗舰模型:GLM-5。

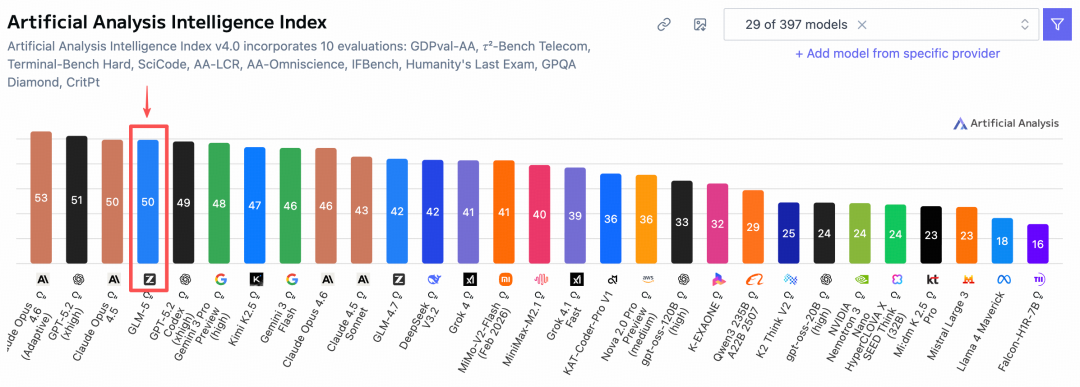

在全球权威的Artificial Analysis榜单里面,GLM-5超越Gemini干到了全球第四、开源第一!

还真是如我所料啊,记得上次GLM-4.7发布的时候,我就在文章里跟兄弟们预测了一波:盲猜GLM-4.8或者GLM-5将在春节前夕发布,没想到真来了,哈哈😄

而且这次的版本号终于不像之前那样4.5、4.6、4.7这样挤牙膏式的更新了,这次直接干到了5.0。

这就说明,不是什么小修小补,是底座能力的大跨越。

先给大家介绍一下,这次GLM-5到底更新了啥:

简单来说,之前的模型,大家普遍都在卷Vibe Coding,就是所谓的一句话生成,看谁生成的网页特效更炫酷,看谁能一句话搓个炫酷的游戏。

但GLM-5这次不跟你卷这个了(终于!),它把大模型的能力从写代码,提升到能构建系统。

什么意思呢?它的重心不再是写漂亮的前端页面,而是进化成了一个能干脏活、累活、做长任务的系统架构师。

强调的是Agentic Engineering,也就是智能体工程能力。

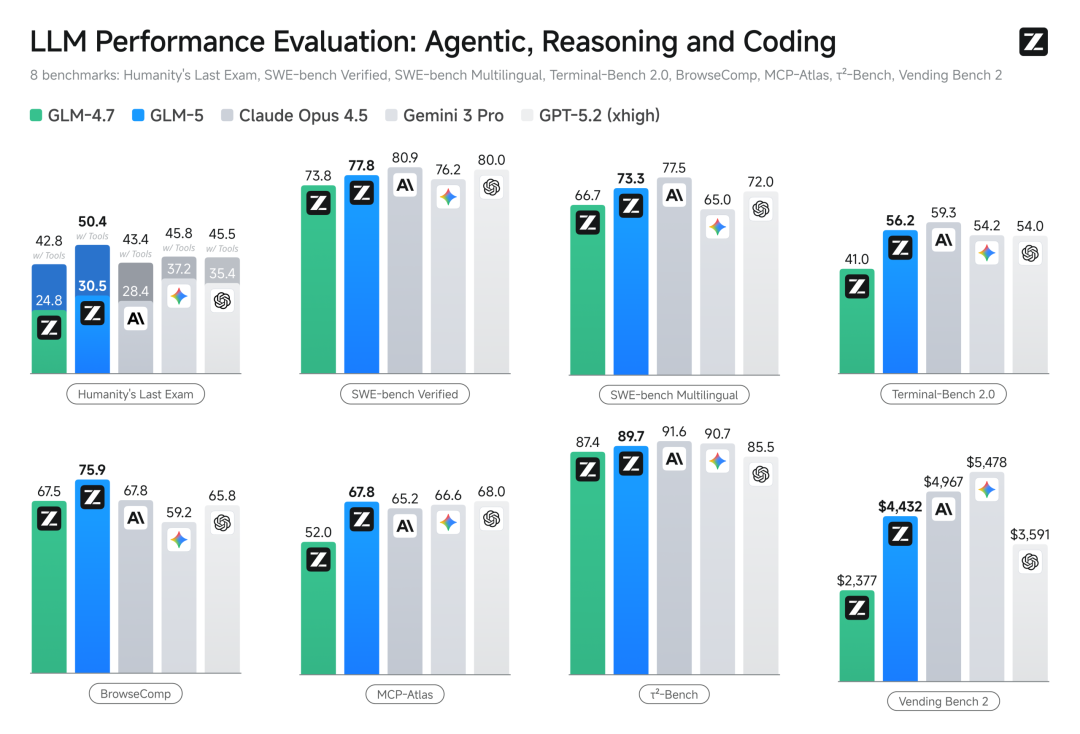

我看了下官方的数据,参数规模从355B干到了744B(激活40),预训练数据从23T提升到了28.5T。

在SWE-bench-Verified这个公认的编程基准测试里,得分77.8,直接把Gemini 3 Pro甩在了身后,和目前公认的最强闭源模型Claude Opus 4.5可以说是不相上下。

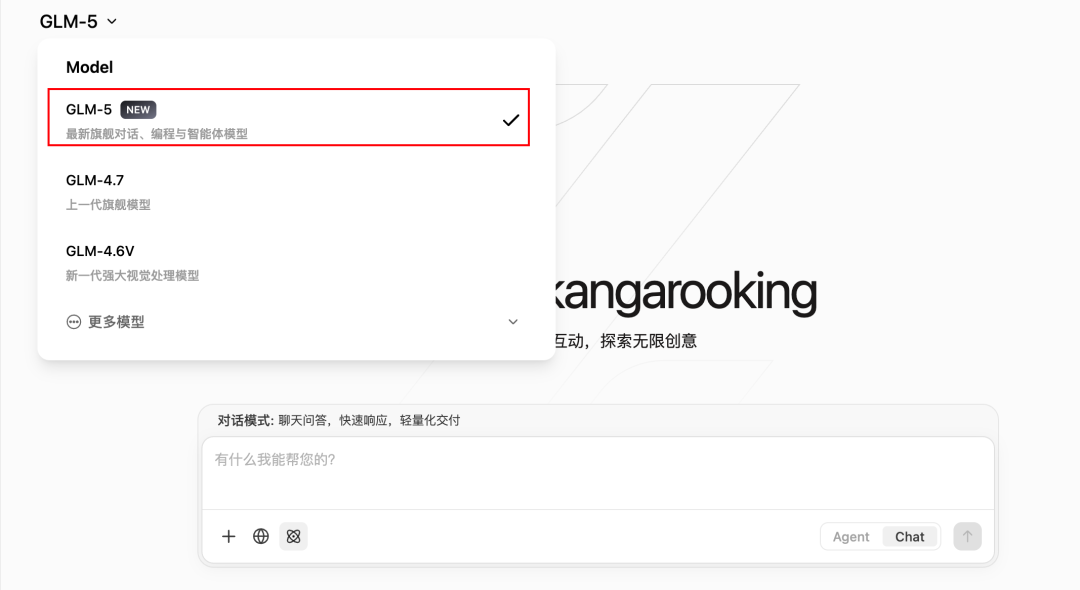

目前在z.ai上面就可以免费使用:

开源地址:

GitHub:https://github.com/zai-org/GLM-5

Hugging Face:https://huggingface.co/zai-org/GLM-5

ModelScope:https://modelscope.cn/models/ZhipuAI/GLM-5

其实在前几天,X上就突然冒出来一个叫Pony的神秘模型。

当时很多朋友都在猜,这个Pony到底是哪路神仙?众说纷纭

其实代号Pony的模型就是GLM-5,至于为什么叫Pony呢,大概是因为马年快到了吧🤔。

我当时也第一时间从OpenRouter把Pony接入到Claude Code里试用了一下,说实话,真滴很强(在X上热度也是非常高)。

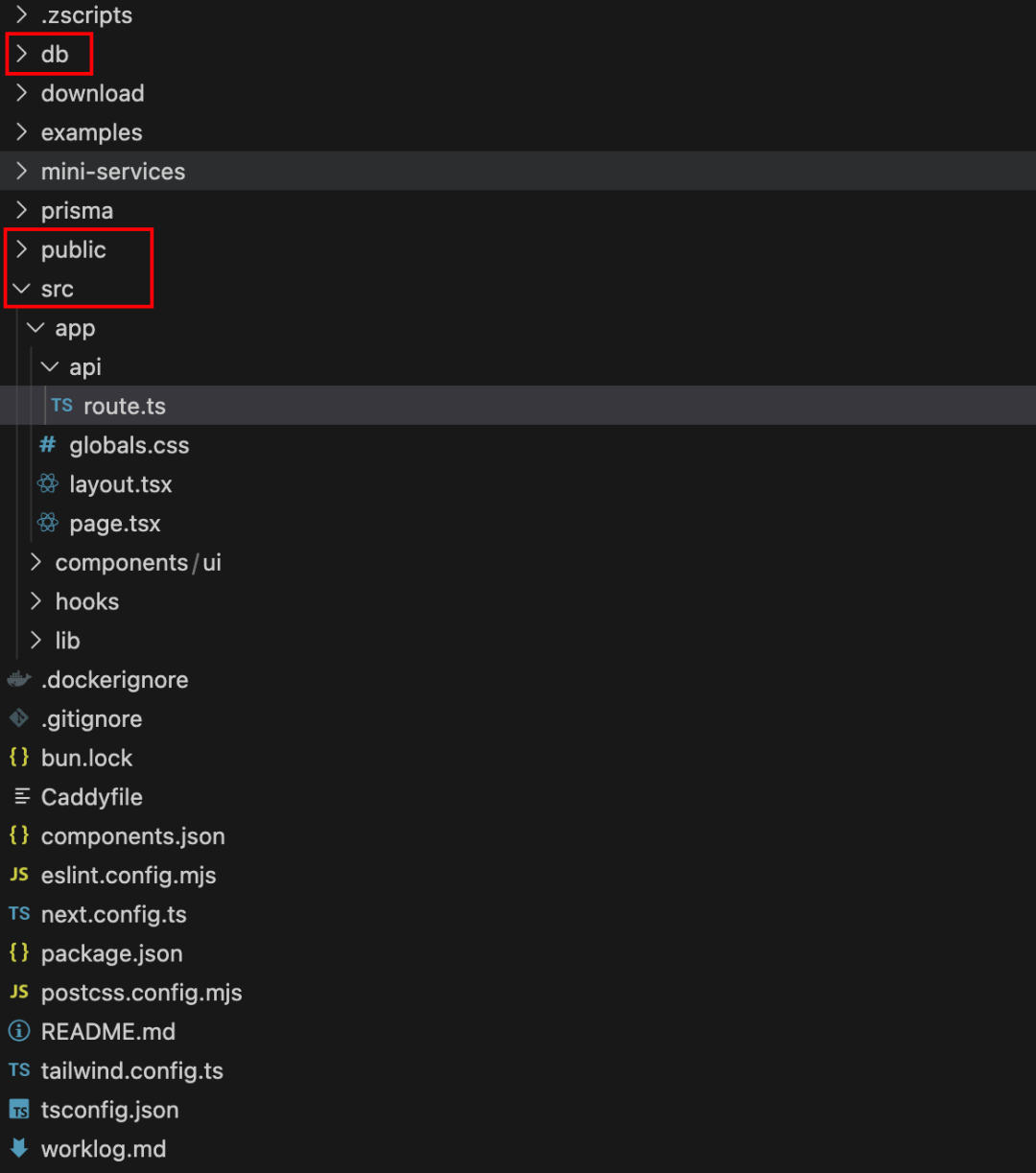

只花了7分钟,一次性生成了一个API中转站!

虽然还是MVP Demo,但是页面功能已经很齐全了,而且包含后端逻辑,以及数据库,数据是动态的,麻雀虽小五脏俱全。

在深度体验后,我发现GLM-5在制定计划的时候,那种味道,太像Claude Opus了。

在深度体验后,我发现GLM-5在制定计划的时候,那种味道,太像Claude Opus了。

熟悉Claude Opus的朋友都知道,在干活之前,可以用它会给你列一个非常详细、逻辑严密的计划。

GLM-5现在也有了这个能力。

比如,我有一个一直想做,但是因为懒一直没动手的事儿。

我手头有Gemini、ChatGPT、Kimi、智谱等等一堆会员账号。

平时写文章或者查资料的时候,有些问题我经常会想听听多个AI的意见,综合对比一下。 Тоді мені доведеться відкривати кілька вікон браузера, копіювати, перемикати різні вікна, вставляти, надсилати кілька разів, а потім по черзі перемикати вікна, щоб переглянути результати.

Хоча це не така вже й велика справа, але це дуже дратує, коли робиш це багато разів.

Я подумав, чи можна зробити плагін для браузера, який би дозволяв одночасно надсилати одне й те саме питання на веб-сайти цих чотирьох ШІ в одному вікні, а потім отримувати відповіді в плагіні?

Але це досить складно, тому що структура кожного веб-сайту ШІ різна, існують різні механізми захисту, і потрібно аналізувати їх структуру DOM.

Тому я доручив це складне завдання GLM-5.

Увімкніть режим плану Claude Code, щоб він спочатку склав план

Потім він також буде взаємодіяти зі мною, запитуючи мою думку:

Отриманий план дуже детальний, дійсно занадто довгий, 633 рядки..

Потім він почав виконувати його згідно з планом, не очікував, що перший крок ініціалізації проекту займе понад 50 хвилин..

У цьому процесі він автоматично викликав інструмент Playwright MCP, сам відкрив браузер і відвідав веб-сайти цих ШІ.

Він як справжній програміст, перевіряє елементи, аналізує, де знаходиться поле введення, який клас у кнопки надсилання, як отримати потік тексту, що повертається... весь процес повністю автоматичний, я не написав жодного рядка коду.

PS: Забув записати екран, тому що одночасно запускав інше завдання в іншому вікні

Очікування варте того, плагін, який я хотів, з одноразовим запитом і одночасною відповіддю від усіх ШІ, щойно з'явився.

Очікування варте того, плагін, який я хотів, з одноразовим запитом і одночасною відповіддю від усіх ШІ, щойно з'явився.

Це саме те, що мені потрібно~

Крім того, я ж раніше робив платформу для створення маркетингових відео з цифровими персонажами одним кліком.

Пізніше, щоб отримати кращий досвід, я переробив інтерфейс, і ця переробка перетворила весь проект на хаос: інтерфейси між переднім і заднім кінцями не збігаються, деякі старі логіки заднього кінця не працюють з новим інтерфейсом, дуже багато помилок, і це дуже клопітно.

Цього разу я увімкнув режим плану в Claude Code, а потім безпосередньо передав завдання пошуку та виправлення помилок основного процесу GLM-5

Спочатку вийшов детальний план:

Після підтвердження плану я дозволив йому почати виконувати його (в процесі використовувався браузер mcp для керування).

Швидкість його виконання не висока.

Але справа не в повільній моделі, часто я бачу, як швидкість споживання токенів миттєво зростає до тисяч за секунду.

Але оскільки завдання занадто складне, йому потрібно постійно самостійно розмірковувати, викликати інструменти, запускати тести.

Деякий час витрачається на завантаження залежностей або виконання команд.

Це завдання з виправлення також тривало понад 40 хвилин.

Можливо, деякі друзі скажуть, 40 хвилин? Я б уже все написав.

Еммм, але протягом цих 40 хвилин я ввімкнув запис екрана, дивився відео і навіть вигуляв собаку.

А він був повністю зосереджений на тому, щоб допомогти мені з роботою, і це була та робота, яка найбільше змушує ламати голову - пошук помилок і рефакторинг.

Не дивлячись на те, що він виконує все повільно, кінцевий результат дуже значний.

Я запускаю його, і, о диво, проблеми в основному вирішені.

Будь ласка, подивіться VCR:

Деякі ефекти я виявив під час тестування пізніше, а потім попросив його виправити та оптимізувати.

Але в плані виправлення помилок і оптимізації функцій я дійсно можу довірити це йому.

Раніше, коли я використовував інші ШІ для виправлення помилок, я часто хвилювався, що помилок стає все більше, а проект стає все більш заплутаним, типовий приклад - залатати дірку, щоб закрити іншу..

Раніше, щоб уникнути цієї проблеми, потрібно було використовувати різні інженерні методи для обмеження ШІ.

Наприклад, кожен раз, коли ви вносите зміни, підкреслюйте діапазон, або записуйте це в правила, або кожен раз виправляйте лише одну помилку, і кожен раз після виправлення потрібно перевіряти інші функції... в будь-якому випадку, це дуже клопітно.

Але досвід виправлення помилок за допомогою GLM-5 повністю змінився.

Мені потрібно лише описати поточну ситуацію, надати йому журнали помилок і сказати, якого ефекту я очікую.

Він майже завжди може успішно виправити їх за один раз, і це абсолютно не впливає на інші функції.

Навіть, в одному діалозі я безпосередньо кинув йому всі чотири різні помилки, виявлені в усьому процесі, і він зміг чітко виправити їх одну за одною.

Це відчуття стабільності дійсно дуже приємне.

Тепер я можу спокійно доручити GLM-5 виконання будь-яких складних завдань з розробки, і в основному не буде помилок.

Навіть якщо іноді виникають проблеми, я можу просто виконати команду відкату в Claude Code, щоб повернутися назад і почати все спочатку.

Після того, як весь проект був оптимізований за допомогою GLM-5, всі процеси в основному були завершені.Я також планую незабаром відкрити цей проєкт (потрібно ще виокремити різні API моделі та перетворити їх на конфігурацію).

«Наостанок»

Після ознайомлення з GLM-5 моє найбільше відчуття: вітчизняний ШІ справді піднявся.

Днями ByteDance випустила Seedance 2.0, що довело, що китайські вітчизняні моделі досягли першого у світі рівня у сфері генерації відео, безпосередньо перевершивши Sora2 та Veo3.1.

А цього разу випуск ZhiPu GLM-5 представив несподівано чудову відповідь на іншому хардкорному треку AI Coding.

Раніше ми завжди казали, що вітчизняні моделі мають відставання від GPT, Claude Opus та Gemini в логічних міркуваннях і написанні коду.

Але сьогодні GLM-5 реальними результатами показує нам: цей розрив згладжується.

GLM-5 – це не іграшка, яку можна використовувати лише для демонстрації, це інструмент продуктивності, який справді може допомогти вам працювати, будувати системи, вирішувати тривалі завдання та складні проблеми.

Найголовніше, що він з відкритим кодом.

Це означає, що кожен розробник, кожне підприємство може мати першокласного AI-архітектора за нижчою ціною.

І наразі Coding Plan GLM вже розпродано, офіційні особи оголосили, що терміново розширюються, і головне, що цього разу підключено кластер із десятками тисяч карт вітчизняних чипів.

Однак через збільшення інвестицій у обчислювальні потужності ціна дещо зросла, добре, що я раніше отримав пакет Max.

Тут також видно, що від чипів до моделей, від базових обчислювальних потужностей до додатків верхнього рівня, ми будуємо власний, першокласний у світі стек технологій ШІ.

2026 рік обов’язково стане роком вибухового розвитку додатків ШІ, а також більш шаленим роком.

Якщо ви також хочете відчути відчуття володіння першокласним AI-архітектором, поспішайте спробувати GLM-5.Передумова - це те, що ти повинен встигнути придбати пакет Max, ха-ха.