智谱GLM-5 lần này mã nguồn mở, khiến cả lập trình viên cao cấp cũng gặp nguy hiểm...

Thật đấy, AI năm 2026 điên cuồng hơn năm 2025 nhiều.

Gần đây, một người như tôi, ngày 16 tiếng đắm mình trong AI, cũng có chút không theo kịp tốc độ tiến hóa của AI. Cảm giác mỗi ngày mở mắt ra, thế giới đã thay đổi.

Chẳng phải đấy sao, đêm qua, Trí Phổ lại tung ra một chiêu lớn, trực tiếp mã nguồn mở mô hình hàng đầu mạnh nhất hiện tại của họ: GLM-5.

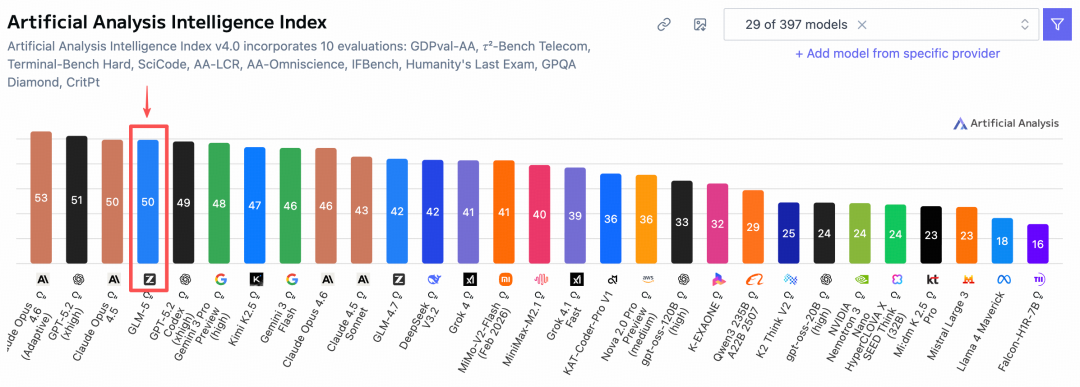

Trong bảng xếp hạng Artificial Analysis uy tín toàn cầu, GLM-5 vượt qua Gemini, vươn lên vị trí thứ tư toàn cầu, thứ nhất mã nguồn mở!

Quả đúng như tôi dự đoán, nhớ lần trước GLM-4.7 ra mắt, tôi đã dự đoán với anh em trong bài viết: đoán mò GLM-4.8 hoặc GLM-5 sẽ ra mắt trước Tết Nguyên Đán, không ngờ lại thành sự thật, haha 😄

Hơn nữa, lần này số phiên bản cuối cùng cũng không còn kiểu cập nhật nhỏ giọt như 4.5, 4.6, 4.7 trước đây nữa, lần này trực tiếp lên 5.0.

Điều này cho thấy, không phải là sửa chữa nhỏ, mà là một bước nhảy vọt lớn về khả năng nền tảng.

Trước tiên, tôi sẽ giới thiệu cho mọi người, lần này GLM-5 đã cập nhật những gì:

Nói một cách đơn giản, các mô hình trước đây, mọi người thường tập trung vào Vibe Coding, tức là cái gọi là tạo ra một câu, xem ai tạo ra hiệu ứng trang web hào nhoáng hơn, xem ai có thể tạo ra một trò chơi hào nhoáng chỉ bằng một câu.

Nhưng GLM-5 lần này không cạnh tranh với bạn về điều này nữa (cuối cùng!), nó đã nâng cao khả năng của mô hình lớn từ viết mã, lên đến khả năng xây dựng hệ thống.

Ý nghĩa là gì? Trọng tâm của nó không còn là viết các trang giao diện người dùng đẹp mắt, mà là tiến hóa thành một kiến trúc sư hệ thống có thể làm những công việc bẩn thỉu, mệt mỏi, và thực hiện các nhiệm vụ dài hạn.

Nhấn mạnh vào Agentic Engineering, tức là khả năng kỹ thuật của tác nhân thông minh.

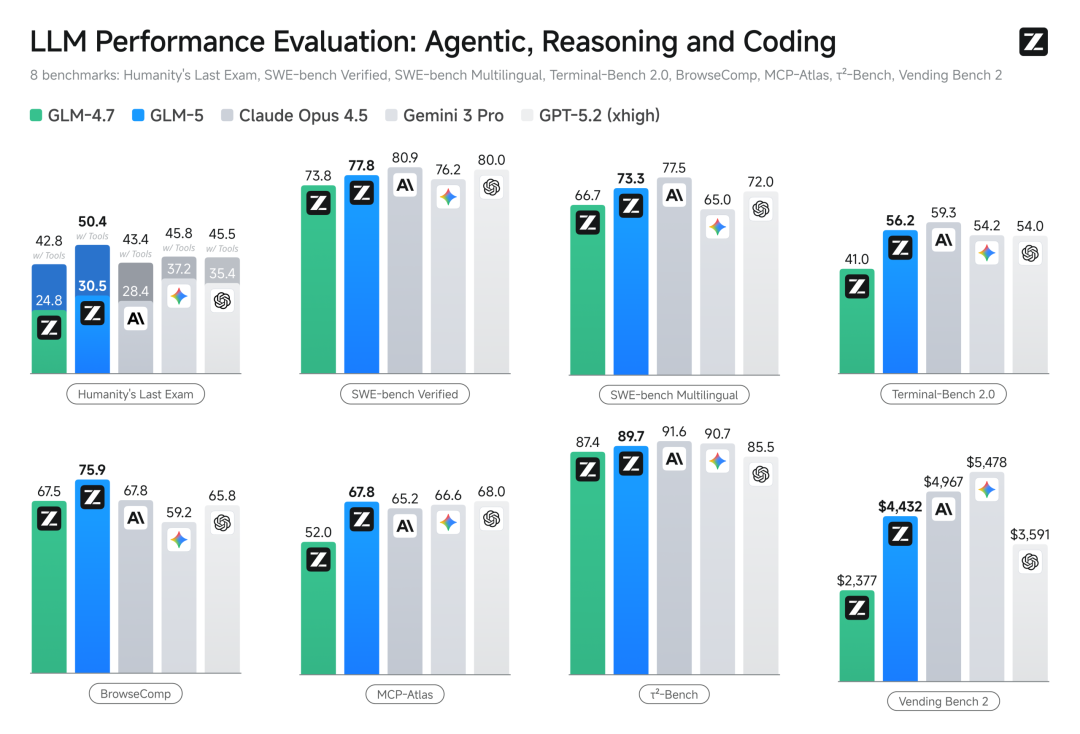

Tôi đã xem dữ liệu chính thức, quy mô tham số từ 355B lên 744B (kích hoạt 40), dữ liệu huấn luyện trước từ 23T lên 28.5T.

Trong SWE-bench-Verified, một tiêu chuẩn kiểm tra lập trình được công nhận, điểm số là 77.8, trực tiếp bỏ xa Gemini 3 Pro, có thể nói là ngang ngửa với Claude Opus 4.5, mô hình nguồn đóng mạnh nhất được công nhận hiện nay.

Hiện tại có thể sử dụng miễn phí trên z.ai:

Địa chỉ mã nguồn mở:

GitHub:https://github.com/zai-org/GLM-5

Hugging Face:https://huggingface.co/zai-org/GLM-5

ModelScope:https://modelscope.cn/models/ZhipuAI/GLM-5

Thực ra, vài ngày trước, trên X đột nhiên xuất hiện một mô hình bí ẩn tên là Pony.

Lúc đó, rất nhiều bạn bè đều đoán, Pony này rốt cuộc là thần thánh phương nào? Ý kiến khác nhau.

Thực ra, mô hình có mật danh Pony chính là GLM-5, còn tại sao lại gọi là Pony, có lẽ là vì năm Ngọ sắp đến 🤔.

Lúc đó, tôi cũng đã ngay lập tức kết nối Pony từ OpenRouter vào Claude Code để dùng thử, nói thật, thực sự rất mạnh (trên X cũng rất hot).

Chỉ mất 7 phút, tạo ra một trạm trung chuyển API một lần!

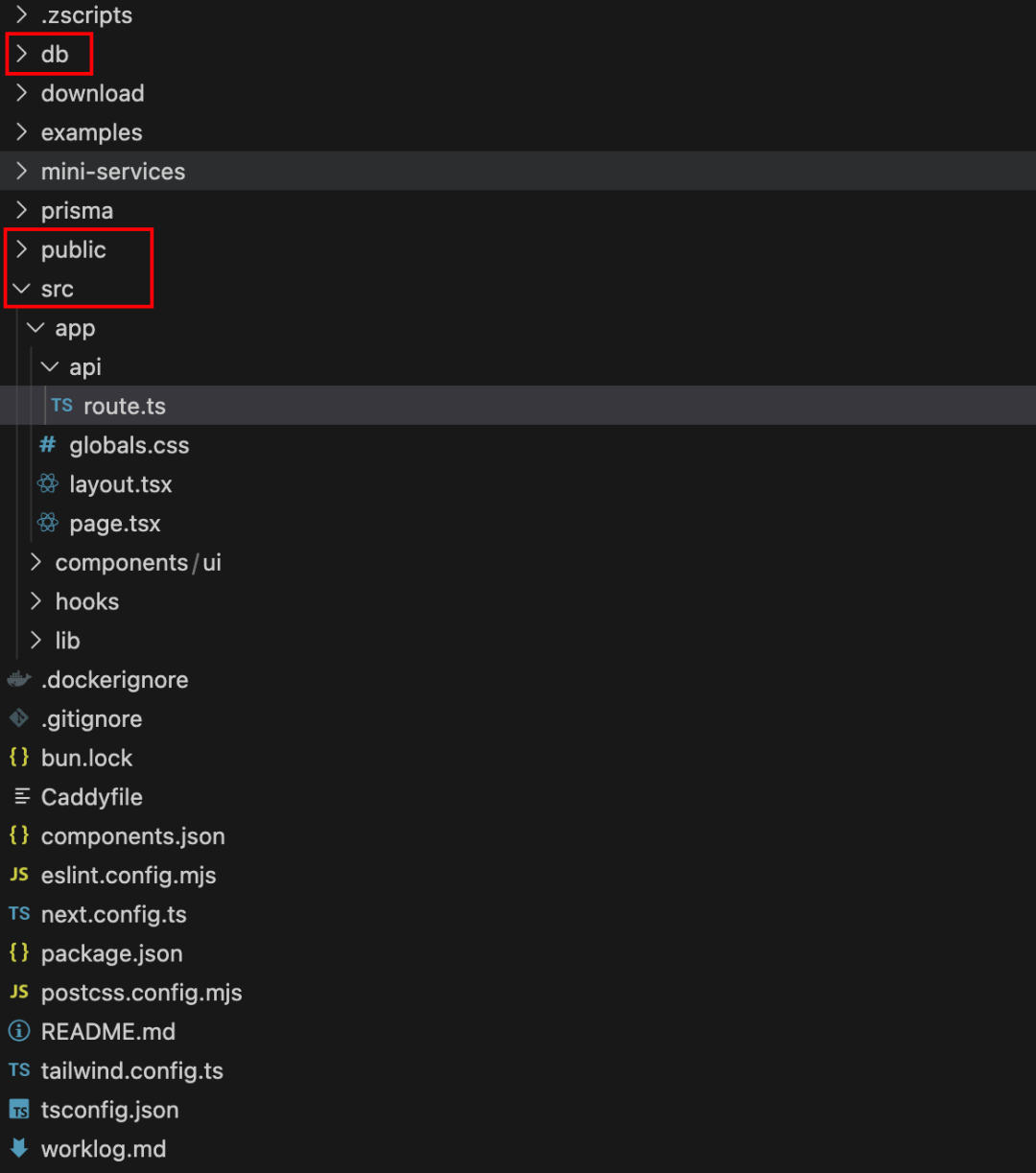

Mặc dù vẫn là MVP Demo, nhưng các chức năng của trang đã rất đầy đủ, hơn nữa còn bao gồm logic backend, và cơ sở dữ liệu, dữ liệu là động, nhỏ nhưng có võ.

Sau khi trải nghiệm sâu, tôi phát hiện ra rằng khi GLM-5 lập kế hoạch, cái mùi vị đó, quá giống Claude Opus.

Sau khi trải nghiệm sâu, tôi phát hiện ra rằng khi GLM-5 lập kế hoạch, cái mùi vị đó, quá giống Claude Opus.

Những người quen thuộc với Claude Opus đều biết, trước khi làm việc, nó có thể liệt kê cho bạn một kế hoạch rất chi tiết, logic chặt chẽ.

GLM-5 hiện cũng có khả năng này.

Ví dụ, tôi có một việc luôn muốn làm, nhưng vì lười nên vẫn chưa bắt tay vào làm.

Tôi có trong tay một loạt tài khoản thành viên của Gemini, ChatGPT, Kimi, Trí Phổ, v.v.

Bình thường khi viết bài hoặc tra cứu tài liệu, có một số vấn đề tôi thường muốn nghe ý kiến của nhiều AI, so sánh tổng hợp.Vậy là tôi phải mở nhiều cửa sổ trình duyệt, sao chép và chuyển đổi giữa các cửa sổ khác nhau để dán và gửi nhiều lần, sau đó lần lượt chuyển đổi cửa sổ để xem kết quả.

Mặc dù không phải là chuyện gì to tát, nhưng làm nhiều lần thì thực sự rất khó chịu.

Tôi đã nghĩ, liệu có thể tạo một plugin trình duyệt, có thể thống nhất trong một cửa sổ, đồng thời gửi cùng một câu hỏi đến trang web của bốn AI này, và sau đó nhận phản hồi thống nhất trong plugin không?

Nhưng cái này khá phức tạp, vì cấu trúc của mỗi trang web AI là khác nhau, và có nhiều cơ chế bảo vệ khác nhau, cần phải phân tích cấu trúc DOM của chúng.

Vì vậy, tôi đã giao nhiệm vụ phức tạp này cho GLM-5.

Mở Plan Mode của Claude Code trước để nó lập kế hoạch

Sau đó, nó sẽ tương tác với tôi và hỏi ý kiến của tôi:

Kế hoạch cuối cùng rất chi tiết, thực sự quá dài, có 633 dòng..

Sau đó, nó bắt đầu thực hiện theo kế hoạch, không ngờ bước đầu tiên khởi tạo dự án đã chạy hơn 50 phút..

Trong quá trình này, nó tự động gọi công cụ Playwright MCP, tự mở trình duyệt, truy cập các trang web AI đó.

Nó giống như một lập trình viên thực thụ, kiểm tra các phần tử, phân tích vị trí của hộp nhập liệu, Class của nút gửi là gì, cách lấy luồng văn bản trả về... Toàn bộ quá trình hoàn toàn tự động, tôi không viết một dòng mã nào.

PS: Quên quay màn hình rồi, vì tôi đồng thời đang chạy một nhiệm vụ khác trong các cửa sổ khác

Chờ đợi là xứng đáng, plugin mà tôi muốn, một lần đặt câu hỏi, toàn bộ AI trên mạng đồng thời trả lời, đã ra lò nóng hổi.

Chờ đợi là xứng đáng, plugin mà tôi muốn, một lần đặt câu hỏi, toàn bộ AI trên mạng đồng thời trả lời, đã ra lò nóng hổi.

Đây hoàn toàn là thứ tôi cần~

Ngoài ra, trước đây tôi không phải đã làm một nền tảng tạo video marketing bằng người ảo chỉ bằng một cú nhấp chuột sao.

Sau này, để theo đuổi trải nghiệm tốt hơn, tôi đã tái cấu trúc giao diện người dùng, việc tái cấu trúc này không quan trọng, toàn bộ dự án có thể nói là rối tung cả lên: giao diện trước và sau không khớp, một số logic cũ ở phần phụ trợ không chạy được trước giao diện người dùng mới, có rất nhiều lỗi, rất khó để xử lý.

Lần này, tôi đã mở plan mode trong Claude Code, và sau đó trực tiếp giao nhiệm vụ tìm lỗi và sửa lỗi của quy trình chính cho GLM-5

Đầu tiên đưa ra một kế hoạch chi tiết:

Sau khi xác nhận kế hoạch là chính xác, tôi đã để nó bắt đầu thực hiện (trong quá trình này, nó đã sử dụng trình duyệt mcp để điều khiển).

Tốc độ thực hiện của nó không nhanh.

Nhưng không phải là mô hình chậm, nhiều lúc, tôi thấy tốc độ tiêu thụ Token, có thể thấy bằng mắt thường là trong một giây đã vọt lên hàng nghìn.

Nhưng vì nhiệm vụ quá phức tạp, nó cần phải liên tục tự suy ngẫm, gọi công cụ, chạy thử nghiệm.

Cũng có một số thời gian bị tiêu tốn vào việc tải xuống các phụ thuộc hoặc thực hiện các lệnh.

Nhiệm vụ sửa chữa này cũng mất đến hơn 40 phút.

Có thể một số bạn sẽ nói, 40 phút? Tôi đã viết xong rồi.

Emmm, nhưng trong 40 phút này, tôi đã mở quay màn hình, xem video, thậm chí đi dắt chó đi dạo.

Còn nó thì đang tập trung giúp tôi làm việc, và là làm những công việc đau đầu nhất là tìm lỗi và tái cấu trúc.

Đừng thấy nó thực hiện chậm, nhưng hiệu quả cuối cùng là rất đáng kể.

Tôi vừa chạy thử, ôi chao, các vấn đề cơ bản đã được giải quyết.

Mời xem VCR:

Trong đó cũng có một số hiệu ứng là do tôi tự kiểm tra sau đó phát hiện ra lỗi nhỏ, sau đó yêu cầu nó sửa chữa và tối ưu hóa.

Nhưng trong việc sửa lỗi và tối ưu hóa chức năng, tôi thực sự yên tâm giao cho nó.

Trước đây, khi sử dụng AI khác để sửa lỗi, tôi thường lo lắng rằng càng sửa thì càng nhiều lỗi, dự án càng sửa càng rối, điển hình là vá chỗ này hỏng chỗ kia..

Trước đây, để tránh vấn đề này, tôi phải sử dụng nhiều phương pháp kỹ thuật để ràng buộc AI.

Ví dụ, mỗi lần sửa đều nhấn mạnh phạm vi, hoặc viết những điều này vào quy tắc, hoặc mỗi lần chỉ sửa một lỗi, mỗi lần sửa xong, phải kiểm tra các chức năng khác... Nói chung là rất phiền phức.

Nhưng khi sử dụng GLM-5 để sửa lỗi, trải nghiệm hoàn toàn thay đổi.

Tôi chưa bao giờ chỉ cần mô tả hiện trạng, ném nhật ký lỗi cho nó, nói cho nó biết hiệu quả mà tôi mong muốn là gì.

Nó gần như có thể sửa chữa thành công một lần, và hoàn toàn không ảnh hưởng đến các chức năng khác.

Thậm chí, trong một cuộc trò chuyện, tôi đã ném tất cả bốn lỗi khác nhau được phát hiện trong toàn bộ quy trình cho nó, nó cũng có thể sửa chữa từng lỗi một cách mạch lạc.

Cảm giác ổn định này thực sự rất thoải mái.

Bây giờ tôi có thể yên tâm giao cho GLM-5 giúp tôi hoàn thành bất kỳ nhiệm vụ phát triển phức tạp nào, về cơ bản sẽ không có lỗi.

Ngay cả khi thỉnh thoảng có vấn đề, cùng lắm thì thực hiện lệnh hoàn tác trong Claude Code, quay lại làm lại là xong.

Sau khi toàn bộ dự án được GLM-5 tối ưu hóa một vòng, tất cả các quy trình về cơ bản đã được giải quyết.Tôi cũng chuẩn bị sớm công khai mã nguồn dự án này (cần phải tách phần API của các mô hình khác nhau ra, biến thành cấu hình).

「Cuối cùng」

Sau khi trải nghiệm GLM-5, cảm nhận lớn nhất của tôi là: AI nội địa của Trung Quốc thực sự đã đứng lên.

Hai ngày trước, Seedance 2.0 của ByteDance được phát hành, chứng minh rằng mô hình nội địa của Trung Quốc đã đạt đến trình độ hàng đầu thế giới trong lĩnh vực tạo video, vượt qua trực tiếp Sora2 và Veo3.1.

Còn lần phát hành GLM-5 của Zhipu lần này, lại là một câu trả lời vượt quá mong đợi trong một đường đua AI Coding khó nhằn khác.

Trước đây chúng ta thường nói rằng, mô hình nội địa còn khoảng cách so với GPT, Claude Opus, Gemini về suy luận logic, viết code.

Nhưng hôm nay, GLM-5 đã cho chúng ta thấy bằng những biểu hiện thực tế: khoảng cách này đang được san lấp.

GLM-5 không phải là một món đồ chơi chỉ có thể dùng để làm Demo, nó là một công cụ năng suất thực sự có thể giúp bạn làm việc, giúp bạn xây dựng hệ thống, giúp bạn giải quyết các nhiệm vụ dài hạn, các vấn đề phức tạp.

Quan trọng nhất là, nó là mã nguồn mở.

Điều này có nghĩa là, mỗi nhà phát triển, mỗi doanh nghiệp, đều có thể sở hữu một kiến trúc sư AI hàng đầu với chi phí thấp hơn.

Hơn nữa, Coding Plan của GLM hiện đang bán rất chạy, phía chính thức đã ra thông báo rằng, đang khẩn trương mở rộng, và điều quan trọng là, lần này kết nối là cụm vạn card chip nội địa.

Tuy nhiên, do đầu tư lớn vào sức mạnh tính toán, giá cả có tăng lên, may mà trước đó tôi đã mua gói Max

Ở đây cũng có thể thấy, từ chip đến mô hình, từ sức mạnh tính toán cơ bản đến ứng dụng cấp cao, chúng ta đang xây dựng một bộ công nghệ AI hàng đầu thế giới hoàn toàn thuộc về mình.

Năm 2026, chắc chắn là một năm bùng nổ của các ứng dụng AI, cũng là một năm điên cuồng hơn.

Nếu bạn cũng muốn trải nghiệm cảm giác sở hữu một kiến trúc sư AI hàng đầu, hãy nhanh chóng dùng thử GLM-5 nhé.Điều kiện tiên quyết là bạn phải giành được gói Max, haha.