ਪਾਵਰਫੁੱਲ ਆ ਗਿਆ! Claude Code ਲੋਕਲ ਅਨਲਿਮਿਟੇਡ ਟੋਕਨ ਗਾਈਡ

Claude Code ਬਹੁਤ ਸ਼ਕਤੀਸ਼ਾਲੀ ਹੈ, ਪਰ ਟੋਕਨ ਦੀ ਖਪਤ ਦਿਲ ਦੁਖਾਉਂਦੀ ਹੈ!

ਆਖਿਰਕਾਰ, Claude Code ਲੋਕਲ ਮਾਡਲ ਨਾਲ ਕੰਮ ਕਰ ਸਕਦਾ ਹੈ, ਕੌਂਫਿਗਰੇਸ਼ਨ ਬਹੁਤ ਸੌਖੀ ਹੈ।

ਹੇਠਾਂ ਦਾ ਵਾਤਾਵਰਣ Mac Mini4 ਲਈ ਹੈ। Windows ਵਾਤਾਵਰਣ ਵੀ ਚੱਲੇਗਾ।

ਮੌਜੂਦਾ ਦੌਰ ਵਿੱਚ, ਜੇਕਰ ਡੈਸਕਟੌਪ AI ਨਾਲ ਖੇਡਣਾ ਹੈ, ਤਾਂ Mac M ਸੀਰੀਜ਼ ਦੇ ਛੋਟੇ ਹੋਸਟ, ਜਿਵੇਂ mini4\mini4 pro\m3 ultra\m4 max, ਨੂੰ ਲੈਣ ਦੀ ਸਿਫਾਰਸ਼ ਕੀਤੀ ਜਾਂਦੀ ਹੈ, ਨਿੱਜੀ ਡੈਸਕਟੌਪ AI ਦਾ ਜਾਦੂਈ ਸਾਧਨ।

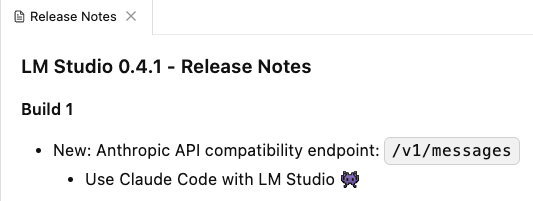

ਸਭ ਤੋਂ ਪਹਿਲਾਂ, LM Studio ਨੂੰ ਨਵੇਂ ਸੰਸਕਰਣ 0.4.1 ਵਿੱਚ ਅੱਪਗ੍ਰੇਡ ਕਰਨ ਦੀ ਲੋੜ ਹੈ, ਕਿਉਂਕਿ ਨਵੇਂ ਸੰਸਕਰਣ ਵਿੱਚ Claude Code ਲਈ ਸਹਾਇਤਾ ਜੋੜੀ ਗਈ ਹੈ। (Ollama ਵੀ ਚੱਲੇਗਾ)

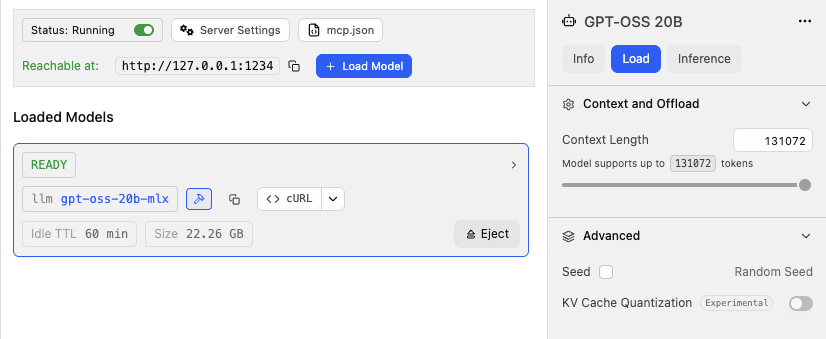

ਤੁਸੀਂ ਆਪਣੇ ਲੋਕਲ ਵਿੱਚ ਕੋਈ ਵੀ ਓਪਨ-ਸੋਰਸ ਮਾਡਲ ਚਲਾ ਸਕਦੇ ਹੋ, ਜਿੰਨਾ ਤੁਹਾਡੇ Mac ਦੀ ਮੈਮੋਰੀ ਕਾਫੀ ਹੋਵੇ। ਅਸੀਂ gpt-oss-20b-mlx ਨੂੰ ਉਦਾਹਰਨ ਵਜੋਂ ਲੈਂਦੇ ਹਾਂ, ਇਹ OpenAI ਦਾ ਇੱਕ ਓਪਨ-ਸੋਰਸ ਮਾਡਲ ਹੈ।

ਇੱਕ ਗੱਲ ਧਿਆਨ ਦਿਓ: Context length ਨੂੰ ਪੂਰਾ ਖਿੱਚੋ, ਯਾਨੀ ਕਿ ਸੰਦਰਭ ਲੰਬਾਈ ਨੂੰ ਮਾਡਲ ਦੁਆਰਾ ਸਹਾਇਤਾ ਪ੍ਰਾਪਤ ਅਧਿਕਤਮ ਤੱਕ ਲੈ ਜਾਓ, ਕਿਉਂਕਿ ਏਜੰਟ ਦੀ ਮਲਟੀ-ਰਾਊਂਡ ਟਾਸਕ ਪ੍ਰਦਰਸ਼ਨ ਸੰਦਰਭ ਦੀ ਲੰਬਾਈ 'ਤੇ ਬਹੁਤ ਨਿਰਭਰ ਕਰਦਾ ਹੈ, ਛੋਟਾ ਨਹੀਂ ਚੱਲੇਗਾ। ਇਹ ਪੈਰਾਮੀਟਰ ਤੁਹਾਡੇ Mac ਦੀ ਮੈਮੋਰੀ ਅਤੇ ਮਾਡਲ ਦੀ ਇਨਫਰੈਂਸ ਸਪੀਡ ਦੇ ਅਨੁਸਾਰ ਸੰਤੁਲਿਤ ਕਰਕੇ ਅਡਜੱਸਟ ਕਰਨਾ ਹੋਵੇਗਾ। ਇੱਕ ਹੋਰ ਗੱਲ ਧਿਆਨ ਦਿਓ: Mac ਵਾਤਾਵਰਣ ਵਿੱਚ, MLX ਫਾਰਮੈਟ ਦੇ ਮਾਡਲ ਨੂੰ ਪਹਿਲ ਦਿਓ, ਇਨਫਰੈਂਸ ਸਪੀਡ GGUF ਫਾਰਮੈਟ ਦੇ ਮਾਡਲਾਂ ਨਾਲੋਂ ਤੇਜ਼ ਹੁੰਦੀ ਹੈ।

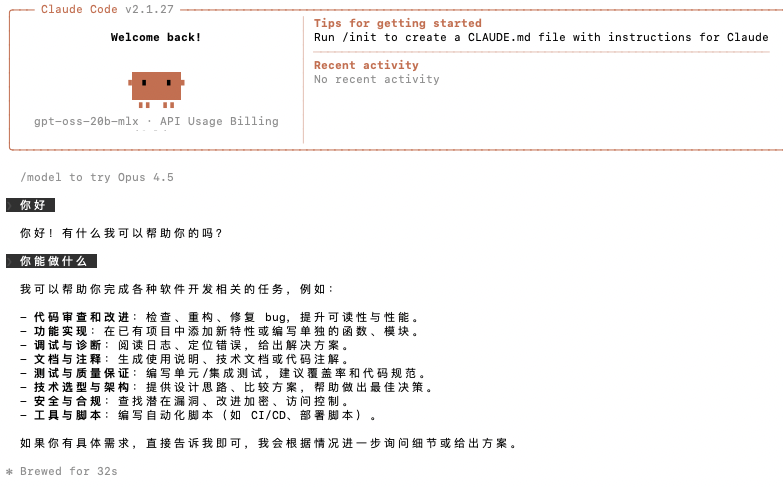

ਅੱਗੇ, ਅਸੀਂ ਕਮਾਂਡ ਲਾਈਨ ਟਰਮੀਨਲ ਵਿੱਚ claude code ਇੰਸਟਾਲ ਕਰਦੇ ਹਾਂ।

ਵਾਤਾਵਰਣ ਵੇਰੀਏਬਲ ਕੌਂਫਿਗਰ ਕਰੋ:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234claude code ਮੁੱਖ ਭਾਗ ਇੰਸਟਾਲ ਕਰੋ:

npm install -g @anthropic-ai/claude-codeਫਿਰ, claude code ਸ਼ੁਰੂ ਕਰੋ:

claude --model gpt-oss-20b-mlxਇਸ ਸਮੇਂ, claude code ਤੁਹਾਡੇ ਲੋਕਲ ਮਾਡਲ ਨੂੰ ਆਉਟਪੁੱਟ ਲਈ ਕਾਲ ਕਰੇਗਾ।

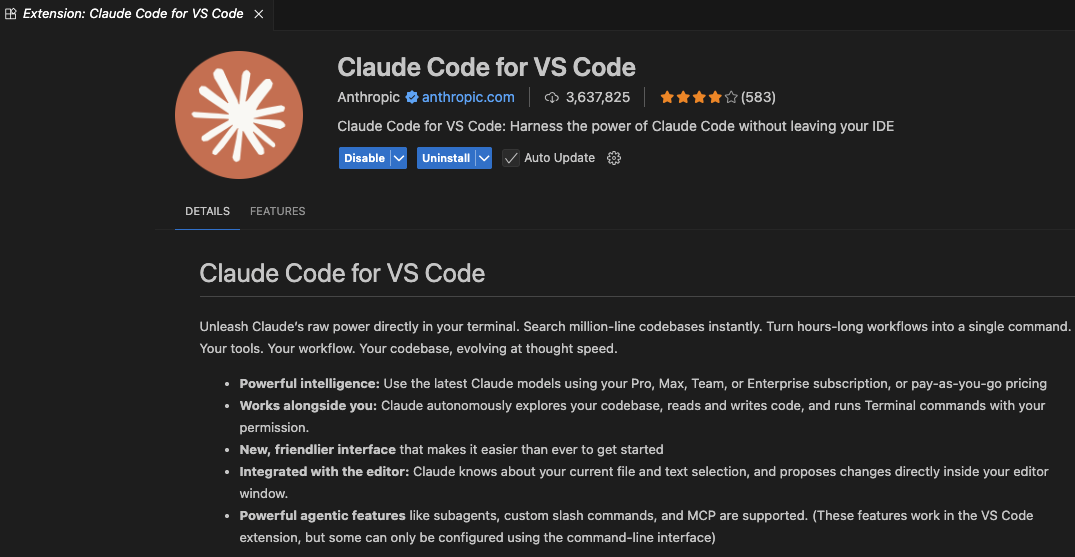

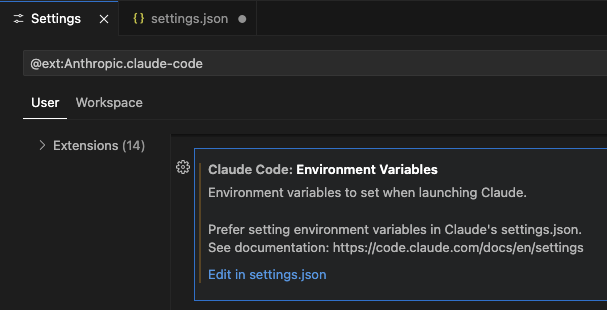

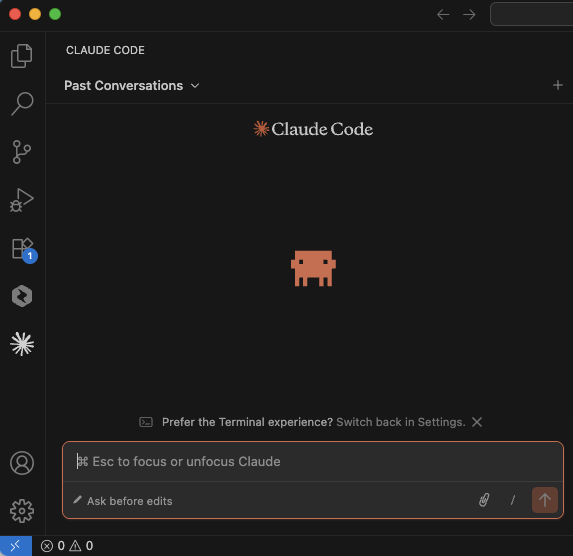

ਟਰਮੀਨਲ ਵਿੱਚ ਵਰਤਣ ਤੋਂ ਇਲਾਵਾ, VS Code ਵਿੱਚ ਵੀ ਵਰਤਿਆ ਜਾ ਸਕਦਾ ਹੈ, ਕੌਂਫਿਗਰੇਸ਼ਨ ਹੇਠਾਂ ਦਿੱਤੀ ਗਈ ਹੈ:

ਟਰਮੀਨਲ ਵਿੱਚ ਵਰਤਣ ਤੋਂ ਇਲਾਵਾ, VS Code ਵਿੱਚ ਵੀ ਵਰਤਿਆ ਜਾ ਸਕਦਾ ਹੈ, ਕੌਂਫਿਗਰੇਸ਼ਨ ਹੇਠਾਂ ਦਿੱਤੀ ਗਈ ਹੈ:

ਅਸੀਂ ਪਹਿਲਾਂ Claude Code for VS Code ਪਲੱਗਇਨ ਇੰਸਟਾਲ ਕਰਦੇ ਹਾਂ।

ਫਿਰ ਵਾਤਾਵਰਣ ਵੇਰੀਏਬਲ ਸੈੱਟ ਕਰੋ:

ਫਿਰ ਵਾਤਾਵਰਣ ਵੇਰੀਏਬਲ ਸੈੱਟ ਕਰੋ:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}ਫਿਰ ਤੁਸੀਂ ਕੰਮ ਸ਼ੁਰੂ ਕਰ ਸਕਦੇ ਹੋ।

ਸੋਚਣ ਵਾਲੀ ਗੱਲ: ਕੀ Anthropic ਮਾਡਲ ਦੀ ਵਰਤੋਂ ਨਾ ਕਰਨ ਵਾਲਾ Claude Code ਉਹੀ Claude Code ਰਹਿੰਦਾ ਹੈ?

ਸੋਚਣ ਵਾਲੀ ਗੱਲ: ਕੀ Anthropic ਮਾਡਲ ਦੀ ਵਰਤੋਂ ਨਾ ਕਰਨ ਵਾਲਾ Claude Code ਉਹੀ Claude Code ਰਹਿੰਦਾ ਹੈ?

ਅਸੀਂ ਵਰਤ ਰਹੇ gpt-oss-20b-mlx ਮਾਡਲ ਦੀ ਸਮਰੱਥਾ ਨਿਸ਼ਚਿਤ ਤੌਰ 'ਤੇ Opus 4.5 ਨਾਲ ਤੁਲਨਾ ਨਹੀਂ ਕੀਤੀ ਜਾ ਸਕਦੀ, ਪਰ ਜੇਕਰ ਤੁਸੀਂ ਲੋਕਲ ਵਾਤਾਵਰਣ ਵਿੱਚ Kimi K2.5 ਤੈਨਾਤ ਕੀਤਾ ਹੈ, ਤਾਂ ਫਿਲਹਾਲ, ਸਮਰੱਥਾ Opus 4.5 ਤੋਂ ਬਿਲਕੁਲ ਘੱਟ ਨਹੀਂ ਹੈ।